O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

Apache Hadoop este un instrument open source de procesare a datelor Big, utilizat pe scară largă în industria IT.

În funcție de dimensiunea, tipul și scara datelor dvs., puteți implementa Hadoop în regim de sine stătător sau în modul cluster.

În acest tutorial axat pe începători, vom instala Hadoop în modul de sine stătător pe o instanță a serverului CentOS 7.

Conectați-vă ca utilizator sudo și apoi actualizați sistemul CentOS 7 la cel mai recent statut stabil:

sudo yum install epel-release -y

sudo yum update -y

sudo shutdown -r now

După ce serverul este conectat, conectați-vă.

Hadoop este bazat pe Java, iar OpenJDK 8 este versiunea recomandată pentru cea mai recentă versiune stabilă.

Instalați OpenJDK 8 JRE folosind YUM:

sudo yum install -y java-1.8.0-openjdk

Verificați instalarea OpenJDK 8 JRE:

java -version

Produsul ar trebui să semene cu:

openjdk version "1.8.0_111"

OpenJDK Runtime Environment (build 1.8.0_111-b15)

OpenJDK 64-Bit Server VM (build 25.111-b15, mixed mode)

Puteți găsi întotdeauna adresa URL de descărcare a celei mai recente versiuni de Hadoop din pagina oficială de lansare Apache Hadoop . În momentul scrierii acestui articol, ultima versiune stabilă a Hadoop este 2.7.3.

Descărcați arhiva binară a Hadoop 2.7.3:

cd

wget http://www-us.apache.org/dist/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz

Descărcați fișierul de control corespunzător:

wget https://dist.apache.org/repos/dist/release/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz.mds

Instalați instrumentul checkum:

sudo yum install perl-Digest-SHA

Calculați valoarea SHA256 a arhivei Hadoop:

shasum -a 256 hadoop-2.7.3.tar.gz

Afișați conținutul fișierului hadoop-2.7.3.tar.gz.mdsși asigurați-vă că cele două valori SHA256 sunt identice:

cat hadoop-2.7.3.tar.gz.mds

Decuplați arhiva într-o locație desemnată:

sudo tar -zxvf hadoop-2.7.3.tar.gz -C /opt

Înainte de a putea rula Hadoop corect, trebuie să specificați locația de origine Java pentru aceasta.

Deschideți fișierul de configurare a mediului Hadoop /opt/hadoop-2.7.3/etc/hadoop/hadoop-env.shutilizând visau editorul de text preferat:

sudo vi /opt/hadoop-2.7.3/etc/hadoop/hadoop-env.sh

Găsiți linia:

export JAVA_HOME=$

Înlocuiți-l cu:

export JAVA_HOME=$(readlink -f /usr/bin/java | sed "s:bin/java::")

Această setare va face ca Hadoop să folosească întotdeauna locația implicită de instalare a Java.

Salvează și închide:

:wq!

Puteți adăuga calea programului Hadoop la PATHvariabila de mediu pentru confortul dvs.:

echo "export PATH=/opt/hadoop-2.7.3/bin:$PATH" | sudo tee -a /etc/profile

source /etc/profile

Pur și simplu executați comanda hadoopși vi se va solicita utilizarea comenzii hadoop și a diferiților parametri ai acesteia.

Aici, puteți utiliza un exemplu încorporat pentru a testa instalarea Hadoop.

Pregătiți sursa de date:

mkdir ~/source

cp /opt/hadoop-2.7.3/etc/hadoop/*.xml ~/source

Utilizați Hadoop împreună cu grep pentru a da rezultatul:

hadoop jar /opt/hadoop-2.7.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.3.jar grep ~/source ~/output 'principal[.]*'

Produsul ar trebui să fie:

...

File System Counters

FILE: Number of bytes read=1247812

FILE: Number of bytes written=2336462

FILE: Number of read operations=0

FILE: Number of large read operations=0

FILE: Number of write operations=0

Map-Reduce Framework

Map input records=2

Map output records=2

Map output bytes=37

Map output materialized bytes=47

Input split bytes=117

Combine input records=0

Combine output records=0

Reduce input groups=2

Reduce shuffle bytes=47

Reduce input records=2

Reduce output records=2

Spilled Records=4

Shuffled Maps =1

Failed Shuffles=0

Merged Map outputs=1

GC time elapsed (ms)=24

Total committed heap usage (bytes)=262758400

Shuffle Errors

BAD_ID=0

CONNECTION=0

IO_ERROR=0

WRONG_LENGTH=0

WRONG_MAP=0

WRONG_REDUCE=0

File Input Format Counters

Bytes Read=151

File Output Format Counters

Bytes Written=37

În cele din urmă, puteți vizualiza conținutul fișierelor de ieșire:

cat ~/output/*

Rezultatul ar trebui să fie:

6 principal

1 principal.

Acum sunteți gata să explorați Hadoop.

O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

Citiți blogul pentru a cunoaște diferitele straturi din Arhitectura Big Data și funcționalitățile acestora în cel mai simplu mod.

Mulți dintre voi cunoașteți Switch care va fi lansat în martie 2017 și noile sale funcții. Pentru cei care nu știu, am pregătit o listă de funcții care fac din „Switch” un „gadget obligatoriu”.

Aștepți ca giganții tehnologiei să-și îndeplinească promisiunile? vezi ce a ramas nelivrat.

Citiți asta pentru a afla cum devine populară inteligența artificială în rândul companiilor la scară mică și cum crește probabilitățile de a le face să crească și de a le oferi concurenților avantaje.

Pe măsură ce Știința Evoluează într-un ritm rapid, preluând multe dintre eforturile noastre, crește și riscurile de a ne supune unei Singularități inexplicabile. Citiți, ce ar putea însemna singularitatea pentru noi.

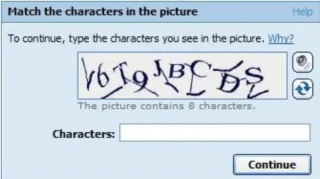

CAPTCHA a devenit destul de dificil de rezolvat pentru utilizatori în ultimii ani. Va fi capabil să rămână eficient în detectarea spam-ului și a botului în viitor?

Ce este telemedicina, îngrijirea medicală la distanță și impactul acesteia asupra generației viitoare? Este un loc bun sau nu în situația de pandemie? Citiți blogul pentru a găsi o vedere!

Poate ați auzit că hackerii câștigă mulți bani, dar v-ați întrebat vreodată cum câștigă acești bani? sa discutam.

Recent, Apple a lansat macOS Catalina 10.15.4 o actualizare suplimentară pentru a remedia problemele, dar se pare că actualizarea provoacă mai multe probleme care duc la blocarea mașinilor Mac. Citiți acest articol pentru a afla mai multe