O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

Kubernetes este o platformă open-source dezvoltată de Google pentru gestionarea aplicațiilor containerizate într-un grup de servere. Acesta se bazează pe o experiență de zece ani și jumătate pe care Google o are cu rularea grupurilor de containere la scară și oferă dezvoltatorilor infrastructură în stil Google, folosind proiecte open-source de cea mai bună calitate, cum ar fi:

Kubernetes permite dezvoltatorilor să-și definească infrastructura de aplicații în mod declarativ prin intermediul fișierelor YAML și al abstractizărilor precum Pods, RCs și Services (mai multe despre acest lucru mai târziu) și se asigură că clusterul de bază se potrivește în permanență cu starea definită de utilizator.

Unele dintre caracteristicile sale includ:

Treceți mai departe la Instalare dacă sunteți deja familiarizat cu Kubernetes.

Kubernetes oferă dezvoltatorilor următoarele abstractizări (unități logice):

Este unitatea de bază a volumului de lucru Kubernetes. Un pod modelează o „gazdă logică” specifică aplicației într-un mediu containerizat. În termeni laici, modelează un grup de aplicații sau servicii care au fost rulate pe același server din lumea pre-containere. Containerele din interiorul unui pod împărtășesc același spațiu de nume de rețea și pot partaja și volume de date.

Podurile sunt grozave pentru gruparea mai multor containere în unități de aplicații logice, dar nu oferă replicare sau reprogramare în caz de defecțiune a serverului.

Acesta este un controler de replicare sau RC este la îndemână. Un RC se asigură că o serie de poduri ale unui anumit serviciu rulează întotdeauna pe întregul cluster.

Ele sunt metadate cu valoare cheie care pot fi atașate la orice resursă Kubernetes (poduri, RC-uri, servicii, noduri, ...).

Podurile și controlerele de replicare sunt excelente pentru implementarea și distribuirea aplicațiilor într-un cluster, dar pod-urile au IP-uri efemere care se schimbă la reprogramare sau la repornirea containerului.

Un serviciu Kubernetes oferă un punct final stabil (IP virtual fix + port de legare la serverele gazdă) pentru un grup de poduri gestionate de un controler de replicare.

În forma sa cea mai simplă, un cluster Kubernetes este compus din două tipuri de noduri:

Master Kubernetes este unitatea de control a întregului cluster.

Principalele componente ale masterului sunt:

Nodul Kubernetes sunt serverele de lucru care sunt responsabile de rularea podurilor.

Principalele componente ale unui nod sunt:

În acest ghid, vom crea un cluster cu 3 noduri folosind serverele CentOS 7:

Puteți adăuga cât mai multe noduri suplimentare după cum doriți, urmând aceeași procedură de instalare pentru nodurile Kubernetes.

Configurați numele de gazdă și /etc/hosts:

# /etc/hostname

kube-master

# or kube-node1, kube-node2

# append to /etc/hosts

replace-with-master-server-ip kube-master

replace-with-node1-ip kube-node1

replace-with-node2-ip kube-node2

Dezactivați firewalld:

systemctl disable firewalld

systemctl stop firewalld

Instalați pachetele master Kubernetes:

yum install etcd kubernetes-master

Configurare:

# /etc/etcd/etcd.conf

# leave rest of the lines unchanged

ETCD_LISTEN_CLIENT_URLS="http://0.0.0.0:2379"

ETCD_LISTEN_PEER_URLS="http://localhost:2380"

ETCD_ADVERTISE_CLIENT_URLS="http://0.0.0.0:2379"

# /etc/kubernetes/config

# leave rest of the lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/apiserver

# leave rest of the lines unchanged

KUBE_API_ADDRESS="--address=0.0.0.0"

KUBE_ETCD_SERVERS="--etcd_servers=http://kube-master:2379"

Start Etcd:

systemctl start etcd

Instalați și configurați materialul de rețea de suprapunere Flannel (acest lucru este necesar pentru ca containerele care rulează pe servere diferite să se poată vedea reciproc):

yum install flannel

Creați un fișier de configurare Flannel ( flannel-config.json):

{

"Network": "10.20.0.0/16",

"SubnetLen": 24,

"Backend": {

"Type": "vxlan",

"VNI": 1

}

}

Setați configurația Flannel pe serverul Etcd:

etcdctl set coreos.com/network/config < flannel-config.json

Indicați flanela către serverul Etcd:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Activați serviciile astfel încât să înceapă la pornire:

systemctl enable etcd

systemctl enable kube-apiserver

systemctl enable kube-controller-manager

systemctl enable kube-scheduler

systemctl enable flanneld

Reboot server.

Instalați pachetele de noduri Kubernetes:

yum install docker kubernetes-node

Următorii doi pași vor configura Docker pentru a utiliza suprapunerile pentru o performanță mai bună. Pentru mai multe informații, vizitați această postare pe blog :

Ștergeți directorul curent de stocare a docker-ului:

systemctl stop docker

rm -rf /var/lib/docker

Modificați fișierele de configurare:

# /etc/sysconfig/docker

# leave rest of lines unchanged

OPTIONS='--selinux-enabled=false'

# /etc/sysconfig/docker

# leave rest of lines unchanged

DOCKER_STORAGE_OPTIONS=-s overlay

Configurați kube-node1 pentru a folosi masterul nostru configurat anterior:

# /etc/kubernetes/config

# leave rest of lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/kubelet

# leave rest of the lines unchanged

KUBELET_ADDRESS="--address=0.0.0.0"

# comment this line, so that the actual hostname is used to register the node

# KUBELET_HOSTNAME="--hostname_override=127.0.0.1"

KUBELET_API_SERVER="--api_servers=http://kube-master:8080"

Instalați și configurați materialul de rețea de suprapunere Flannel (din nou - acest lucru este necesar pentru ca containerele care rulează pe servere diferite să se poată vedea reciproc):

yum install flannel

Indicați flanela către serverul Etcd:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Activare servicii:

systemctl enable docker

systemctl enable flanneld

systemctl enable kubelet

systemctl enable kube-proxy

Reporniți serverul.

După ce toate serverele au fost repornite, verificați dacă clusterul dvs. Kubernetes este funcțional:

[root@kube-master ~]# kubectl get nodes

NAME LABELS STATUS

kube-node1 kubernetes.io/hostname=kube-node1 Ready

kube-node2 kubernetes.io/hostname=kube-node2 Ready

Selenium este un cadru pentru automatizarea browserelor în scopuri de testare. Este un instrument puternic de arsenal al oricărui dezvoltator web.

Grila de seleniu permite executarea la distanță scalabilă și paralelă a testelor pe un grup de noduri Selenium care sunt conectate la un hub central Selenium.

Deoarece nodurile Selenium sunt în sine apatride, iar cantitatea de noduri pe care le rulăm este flexibilă, în funcție de sarcinile noastre de testare, aceasta este o aplicație candidată perfectă pentru a fi implementată pe un cluster Kubernetes.

În secțiunea următoare, vom implementa o grilă formată din 5 containere de aplicații:

Pentru a gestiona automat replicarea și auto-vindecarea, vom crea un controler de replicare Kubernetes pentru fiecare tip de container pe care am enumerat mai sus.

Pentru a oferi dezvoltatorilor care efectuează teste cu un punct stabil de hub Selenium stabil, vom crea un serviciu Kubernetes conectat la controlerul de replicare hub.

# selenium-hub-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-hub

spec:

replicas: 1

selector:

name: selenium-hub

template:

metadata:

labels:

name: selenium-hub

spec:

containers:

- name: selenium-hub

image: selenium/hub

ports:

- containerPort: 4444

Implementare:

[root@kube-master ~]# kubectl create -f selenium-hub-rc.yaml

replicationcontrollers/selenium-hub

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 0 50s

[root@kube-master ~]# kubectl describe pod selenium-hub-pilc8

Name: selenium-hub-pilc8

Namespace: default

Image(s): selenium/hub

Node: kube-node2/45.63.16.92

Labels: name=selenium-hub

Status: Running

Reason:

Message:

IP: 10.20.101.2

Replication Controllers: selenium-hub (1/1 replicas created)

Containers:

selenium-hub:

Image: selenium/hub

State: Running

Started: Sat, 24 Oct 2015 16:01:39 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 16:01:02 +0000 Sat, 24 Oct 2015 16:01:02 +0000 1 {scheduler } scheduled Successfully assigned selenium-hub-pilc8 to kube-node2

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Successfully pulled Pod container image "gcr.io/google_containers/pause:0.8.0"

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/hub"

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 7583cc09268c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 7583cc09268c

Aici putem vedea că Kubernetes mi-a plasat containerul cu butuc de seleniu pe kube-node2.

# selenium-hub-service.yaml

apiVersion: v1

kind: Service

metadata:

name: selenium-hub

spec:

type: NodePort

ports:

- port: 4444

protocol: TCP

nodePort: 30000

selector:

name: selenium-hub

Implementare:

[root@kube-master ~]# kubectl create -f selenium-hub-service.yaml

You have exposed your service on an external port on all nodes in your

cluster. If you want to expose this service to the external internet, you may

need to set up firewall rules for the service port(s) (tcp:30000) to serve traffic.

See http://releases.k8s.io/HEAD/docs/user-guide/services-firewalls.md for more details.

services/selenium-hub

[root@kube-master ~]# kubectl get services

NAME LABELS SELECTOR IP(S) PORT(S)

kubernetes component=apiserver,provider=kubernetes <none> 10.254.0.1 443/TCP

selenium-hub <none> name=selenium-hub 10.254.124.73 4444/TCP

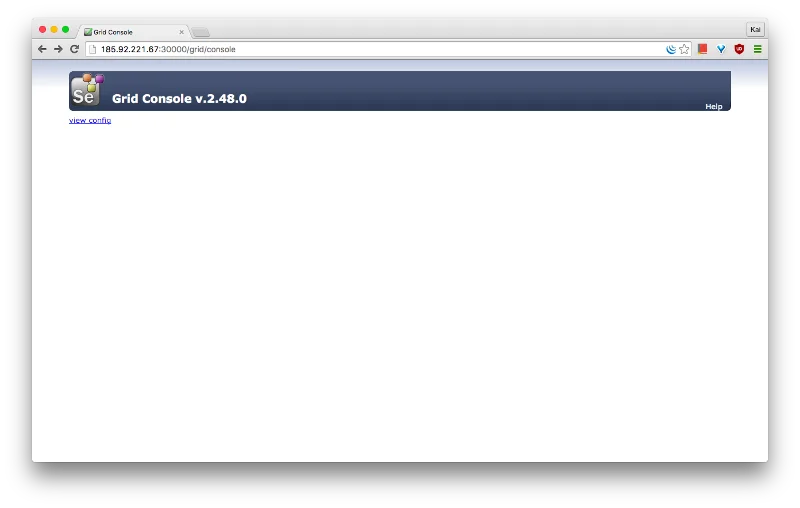

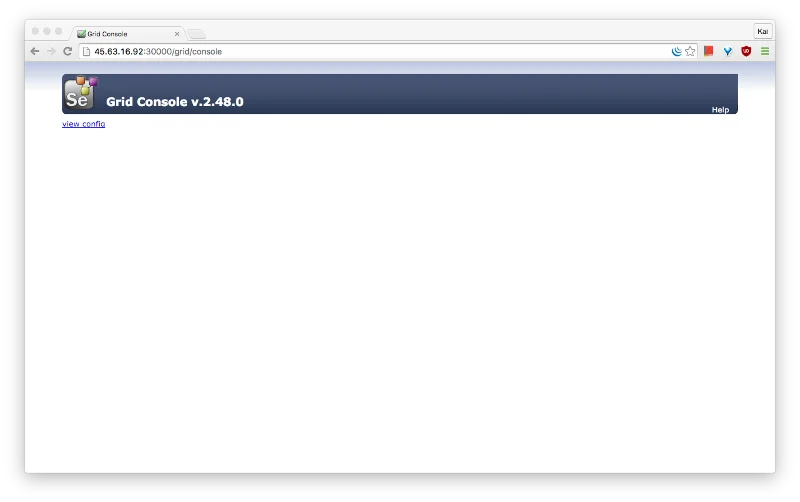

După implementarea serviciului, acesta va putea fi accesat de la:

Controler de replicare a nodului Firefox:

# selenium-node-firefox-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-firefox

spec:

replicas: 2

selector:

name: selenium-node-firefox

template:

metadata:

labels:

name: selenium-node-firefox

spec:

containers:

- name: selenium-node-firefox

image: selenium/node-firefox

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Implementare:

Înlocuiți replace_with_service_ipîn selenium-node-firefox-rc.yamlcu IP real de serviciu hub Seleniu, în acest caz 10.254.124.73.

[root@kube-master ~]# kubectl create -f selenium-node-firefox-rc.yaml

replicationcontrollers/selenium-node-firefox

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-firefox-lc6qt 1/1 Running 0 2m

selenium-node-firefox-y9qjp 1/1 Running 0 2m

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-lc6qt

Name: selenium-node-firefox-lc6qt

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node2/45.63.16.92

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.101.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:37 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-lc6qt to kube-node2

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/node-firefox"

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 8931b7f7a818

Sat, 24 Oct 2015 17:08:37 +0000 Sat, 24 Oct 2015 17:08:37 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 8931b7f7a818

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-y9qjp

Name: selenium-node-firefox-y9qjp

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node1/185.92.221.67

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.92.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:13 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-y9qjp to kube-node1

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD created Created with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD started Started with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers created Created with docker id 6edbd6b9861d

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers started Started with docker id 6edbd6b9861d

După cum putem vedea, Kubernetes a creat 2 replici selenium-firefox-nodeși le-a distribuit prin cluster. Pod selenium-node-firefox-lc6qteste pe Kube-node2, în timp ce pod selenium-node-firefox-y9qjpeste pe Kube-node1.

Repetăm același proces pentru nodurile noastre Chrome Selenium.

Controler de replicare a nodului Chrome:

# selenium-node-chrome-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-chrome

labels:

app: selenium-node-chrome

spec:

replicas: 2

selector:

app: selenium-node-chrome

template:

metadata:

labels:

app: selenium-node-chrome

spec:

containers:

- name: selenium-node-chrome

image: selenium/node-chrome

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Implementare:

[root@kube-master ~]# kubectl create -f selenium-node-chrome-rc.yaml

replicationcontrollers/selenium-node-chrome

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 1m

selenium-node-chrome-mgi52 1/1 Running 0 1m

selenium-node-firefox-lc6qt 1/1 Running 0 11m

selenium-node-firefox-y9qjp 1/1 Running 0 11m

În acest ghid, am creat un mic grup Kubernetes format din 3 servere (1 controler principal + 2 lucrători).

Folosind poduri, RC-uri și un serviciu, am implementat cu succes o grilă Selenium formată dintr-un hub central și 4 noduri, permițând dezvoltatorilor să ruleze simultan 4 teste Selenium simultan pe cluster.

Kubernetes a programat automat containerele pe întregul cluster.

Kubernetes reproșează automat podurile pe serverele sănătoase, dacă unul sau mai mulți dintre serverele noastre scad. În exemplul meu, kube-node2 rulează momentan podul Selenium hub și 1 pod Selenium Firefox nod.

[root@kube-node2 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5617399f146c selenium/node-firefox "/opt/bin/entry_poin 5 minutes ago Up 5 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_baae8e00

185230a3b431 gcr.io/google_containers/pause:0.8.0 "/pause" 5 minutes ago Up 5 minutes k8s_POD.3805e8b7_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_40f809df

fdd5834c249d selenium/hub "/opt/bin/entry_poin About an hour ago Up About an hour k8s_selenium-hub.cb8bf0ed_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_5765e2c9

00e4ccb0bda8 gcr.io/google_containers/pause:0.8.0 "/pause" About an hour ago Up About an hour k8s_POD.3b3ee8b9_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_8398ac33

Vom simula eșecul serverului prin închiderea kube-node2. După câteva minute, ar trebui să vedeți că containerele care rulau pe kube-node2 au fost reprogramate la kube-node1, asigurând o întrerupere minimă a serviciului.

[root@kube-node1 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5bad5f582698 selenium/hub "/opt/bin/entry_poin 19 minutes ago Up 19 minutes k8s_selenium-hub.cb8bf0ed_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_ccaad50a

dd1565a94919 selenium/node-firefox "/opt/bin/entry_poin 20 minutes ago Up 20 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_fc79f977

2be1a316aa47 gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3805e8b7_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_dc204ad2

da75a0242a9e gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3b3ee8b9_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_1b10c0e7

c611b68330de selenium/node-firefox "/opt/bin/entry_poin 33 minutes ago Up 33 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_922af821

828031da6b3c gcr.io/google_containers/pause:0.8.0 "/pause" 33 minutes ago Up 33 minutes k8s_POD.3805e8b7_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_289cd555

caf4e725512e selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_3c6e855a

409a20770787 selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_ac3f0191

7e2d942422a5 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_f5858b73

a3a65ea99a99 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_20a70ab6

Scalarea Selenium Grid este foarte ușoară cu Kubernetes. Imaginați-vă că în loc de 2 noduri Firefox, aș dori să rulez 4. Redimensionarea se poate face cu o singură comandă:

[root@kube-master ~]# kubectl scale rc selenium-node-firefox --replicas=4

scaled

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 4

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 14m

selenium-node-chrome-mgi52 1/1 Running 0 14m

selenium-node-firefox-8ylo2 1/1 Running 0 40s

selenium-node-firefox-lc6qt 1/1 Running 0 24m

selenium-node-firefox-y9qjp 1/1 Running 0 24m

selenium-node-firefox-zmj1r 1/1 Running 0 40s

O perspectivă asupra a 26 de tehnici de analiză a datelor mari: partea 1

Citiți blogul pentru a cunoaște diferitele straturi din Arhitectura Big Data și funcționalitățile acestora în cel mai simplu mod.

Mulți dintre voi cunoașteți Switch care va fi lansat în martie 2017 și noile sale funcții. Pentru cei care nu știu, am pregătit o listă de funcții care fac din „Switch” un „gadget obligatoriu”.

Aștepți ca giganții tehnologiei să-și îndeplinească promisiunile? vezi ce a ramas nelivrat.

Citiți asta pentru a afla cum devine populară inteligența artificială în rândul companiilor la scară mică și cum crește probabilitățile de a le face să crească și de a le oferi concurenților avantaje.

Pe măsură ce Știința Evoluează într-un ritm rapid, preluând multe dintre eforturile noastre, crește și riscurile de a ne supune unei Singularități inexplicabile. Citiți, ce ar putea însemna singularitatea pentru noi.

CAPTCHA a devenit destul de dificil de rezolvat pentru utilizatori în ultimii ani. Va fi capabil să rămână eficient în detectarea spam-ului și a botului în viitor?

Ce este telemedicina, îngrijirea medicală la distanță și impactul acesteia asupra generației viitoare? Este un loc bun sau nu în situația de pandemie? Citiți blogul pentru a găsi o vedere!

Poate ați auzit că hackerii câștigă mulți bani, dar v-ați întrebat vreodată cum câștigă acești bani? sa discutam.

Recent, Apple a lansat macOS Catalina 10.15.4 o actualizare suplimentară pentru a remedia problemele, dar se pare că actualizarea provoacă mai multe probleme care duc la blocarea mașinilor Mac. Citiți acest articol pentru a afla mai multe