CyberPanel installeren en configureren op uw CentOS 7-server

Gebruikt u een ander systeem? Introductie CyberPanel is een van de eerste bedieningspanelen op de markt die zowel open source is als OpenLiteSpeed gebruikt. Wat thi

Kubernetes is een open-sourceplatform dat is ontwikkeld door Google voor het beheren van container-apps op een cluster van servers. Het bouwt voort op anderhalf decennium ervaring die Google heeft met het op grote schaal uitvoeren van clusters van containers , en biedt ontwikkelaars een infrastructuur in Google-stijl, gebruikmakend van de beste open source-projecten, zoals:

Kubernetes laat ontwikkelaars hun applicatie-infrastructuur declaratief definiëren door middel van YAML-bestanden en abstracties zoals Pods, RC's en Services (hierover later meer) en zorgt ervoor dat het onderliggende cluster te allen tijde overeenkomt met de door de gebruiker gedefinieerde status.

Enkele van de kenmerken zijn:

Ga verder met Installatie als u al bekend bent met Kubernetes.

Kubernetes biedt de volgende abstracties (logische eenheden) aan ontwikkelaars:

Het is de basiseenheid van Kubernetes-workloads. Een pod modelleert een toepassingsspecifieke "logische host" in een containeromgeving. In lekentermen modelleert het een groep applicaties of services die vroeger op dezelfde server draaiden in de pre-containerwereld. Containers in een pod delen dezelfde netwerknaamruimte en kunnen ook gegevensvolumes delen.

Pods zijn geweldig voor het groeperen van meerdere containers in logische applicatie-eenheden, maar ze bieden geen replicatie of herschikking in het geval van een serverstoring.

Dit is waar een replicatiecontroller of RC van pas komt. Een RC zorgt ervoor dat een aantal pods van een bepaalde service altijd over het cluster loopt.

Het zijn belangrijke metadata die kunnen worden gekoppeld aan elke Kubernetes-bron (pods, RC's, services, knooppunten, ...).

Pods en replicatiecontrollers zijn geweldig voor het implementeren en distribueren van applicaties over een cluster, maar pods hebben kortstondige IP-adressen die veranderen bij het opnieuw plannen of opnieuw opstarten van de container.

Een Kubernetes-service biedt een stabiel eindpunt (vaste virtuele IP + poortbinding aan de hostservers) voor een groep pods die worden beheerd door een replicatiecontroller.

In zijn eenvoudigste vorm bestaat een Kubernetes-cluster uit twee soorten knooppunten:

De Kubernetes-master is de besturingseenheid van het hele cluster.

De belangrijkste componenten van de master zijn:

Het Kubernetes-knooppunt zijn werkservers die verantwoordelijk zijn voor het uitvoeren van pods.

De belangrijkste componenten van een knooppunt zijn:

In deze handleiding maken we een cluster met 3 knooppunten met behulp van CentOS 7-servers:

U kunt later zoveel extra knooppunten toevoegen als u wilt, door dezelfde installatieprocedure voor Kubernetes-knooppunten te volgen.

Configureer hostnamen en /etc/hosts:

# /etc/hostname

kube-master

# or kube-node1, kube-node2

# append to /etc/hosts

replace-with-master-server-ip kube-master

replace-with-node1-ip kube-node1

replace-with-node2-ip kube-node2

Schakel firewalld uit:

systemctl disable firewalld

systemctl stop firewalld

Installeer Kubernetes-hoofdpakketten:

yum install etcd kubernetes-master

Configuratie:

# /etc/etcd/etcd.conf

# leave rest of the lines unchanged

ETCD_LISTEN_CLIENT_URLS="http://0.0.0.0:2379"

ETCD_LISTEN_PEER_URLS="http://localhost:2380"

ETCD_ADVERTISE_CLIENT_URLS="http://0.0.0.0:2379"

# /etc/kubernetes/config

# leave rest of the lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/apiserver

# leave rest of the lines unchanged

KUBE_API_ADDRESS="--address=0.0.0.0"

KUBE_ETCD_SERVERS="--etcd_servers=http://kube-master:2379"

Start Etcd:

systemctl start etcd

Installeer en configureer Flannel overlay netwerk fabric (dit is nodig zodat containers die op verschillende servers draaien elkaar kunnen zien):

yum install flannel

Maak een Flanel-configuratiebestand ( flannel-config.json):

{

"Network": "10.20.0.0/16",

"SubnetLen": 24,

"Backend": {

"Type": "vxlan",

"VNI": 1

}

}

Stel de Flanel-configuratie in op de Etcd-server:

etcdctl set coreos.com/network/config < flannel-config.json

Wijs Flanel naar de Etcd-server:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Schakel services in zodat ze starten bij het opstarten:

systemctl enable etcd

systemctl enable kube-apiserver

systemctl enable kube-controller-manager

systemctl enable kube-scheduler

systemctl enable flanneld

Start de server opnieuw op.

Installeer Kubernetes-knooppuntpakketten:

yum install docker kubernetes-node

De volgende twee stappen zullen Docker configureren om overlayfs te gebruiken voor betere prestaties. Bezoek dit blogbericht voor meer informatie :

Verwijder de huidige docker-opslagdirectory:

systemctl stop docker

rm -rf /var/lib/docker

Configuratiebestanden wijzigen:

# /etc/sysconfig/docker

# leave rest of lines unchanged

OPTIONS='--selinux-enabled=false'

# /etc/sysconfig/docker

# leave rest of lines unchanged

DOCKER_STORAGE_OPTIONS=-s overlay

Configureer kube-node1 om onze eerder geconfigureerde master te gebruiken:

# /etc/kubernetes/config

# leave rest of lines unchanged

KUBE_MASTER="--master=http://kube-master:8080"

# /etc/kubernetes/kubelet

# leave rest of the lines unchanged

KUBELET_ADDRESS="--address=0.0.0.0"

# comment this line, so that the actual hostname is used to register the node

# KUBELET_HOSTNAME="--hostname_override=127.0.0.1"

KUBELET_API_SERVER="--api_servers=http://kube-master:8080"

Installeer en configureer Flannel overlay netwerk fabric (nogmaals - dit is nodig zodat containers die op verschillende servers draaien elkaar kunnen zien):

yum install flannel

Wijs Flanel naar de Etcd-server:

# /etc/sysconfig/flanneld

FLANNEL_ETCD="http://kube-master:2379"

Services inschakelen:

systemctl enable docker

systemctl enable flanneld

systemctl enable kubelet

systemctl enable kube-proxy

Start de server opnieuw op.

Controleer nadat alle servers opnieuw zijn opgestart of uw Kubernetes-cluster actief is:

[root@kube-master ~]# kubectl get nodes

NAME LABELS STATUS

kube-node1 kubernetes.io/hostname=kube-node1 Ready

kube-node2 kubernetes.io/hostname=kube-node2 Ready

Selenium is een raamwerk voor het automatiseren van browsers voor testdoeleinden. Het is een krachtig hulpmiddel van het arsenaal van elke webontwikkelaar.

Selenium grid maakt schaalbare en parallelle uitvoering op afstand van tests mogelijk in een cluster van seleniumknooppunten die zijn aangesloten op een centrale seleniumhub.

Aangezien Selenium-knooppunten zelf staatloos zijn en het aantal knooppunten dat we gebruiken flexibel is, afhankelijk van onze testworkloads, is dit een perfecte kandidaat-toepassing voor implementatie op een Kubernetes-cluster.

In de volgende sectie implementeren we een raster dat bestaat uit 5 applicatiecontainers:

Om replicatie en zelfherstel automatisch te beheren, maken we een Kubernetes-replicatiecontroller voor elk type applicatiecontainer dat we hierboven hebben vermeld.

Om ontwikkelaars die tests uitvoeren een stabiel Selenium hub-eindpunt te bieden, maken we een Kubernetes-service die is verbonden met de hubreplicatiecontroller.

# selenium-hub-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-hub

spec:

replicas: 1

selector:

name: selenium-hub

template:

metadata:

labels:

name: selenium-hub

spec:

containers:

- name: selenium-hub

image: selenium/hub

ports:

- containerPort: 4444

Implementatie:

[root@kube-master ~]# kubectl create -f selenium-hub-rc.yaml

replicationcontrollers/selenium-hub

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 0 50s

[root@kube-master ~]# kubectl describe pod selenium-hub-pilc8

Name: selenium-hub-pilc8

Namespace: default

Image(s): selenium/hub

Node: kube-node2/45.63.16.92

Labels: name=selenium-hub

Status: Running

Reason:

Message:

IP: 10.20.101.2

Replication Controllers: selenium-hub (1/1 replicas created)

Containers:

selenium-hub:

Image: selenium/hub

State: Running

Started: Sat, 24 Oct 2015 16:01:39 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 16:01:02 +0000 Sat, 24 Oct 2015 16:01:02 +0000 1 {scheduler } scheduled Successfully assigned selenium-hub-pilc8 to kube-node2

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Successfully pulled Pod container image "gcr.io/google_containers/pause:0.8.0"

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:05 +0000 Sat, 24 Oct 2015 16:01:05 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id 6de00106b19c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/hub"

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 7583cc09268c

Sat, 24 Oct 2015 16:01:39 +0000 Sat, 24 Oct 2015 16:01:39 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 7583cc09268c

Hier kunnen we zien dat Kubernetes mijn selenium-hub-container op kube-node2 heeft geplaatst.

# selenium-hub-service.yaml

apiVersion: v1

kind: Service

metadata:

name: selenium-hub

spec:

type: NodePort

ports:

- port: 4444

protocol: TCP

nodePort: 30000

selector:

name: selenium-hub

Implementatie:

[root@kube-master ~]# kubectl create -f selenium-hub-service.yaml

You have exposed your service on an external port on all nodes in your

cluster. If you want to expose this service to the external internet, you may

need to set up firewall rules for the service port(s) (tcp:30000) to serve traffic.

See http://releases.k8s.io/HEAD/docs/user-guide/services-firewalls.md for more details.

services/selenium-hub

[root@kube-master ~]# kubectl get services

NAME LABELS SELECTOR IP(S) PORT(S)

kubernetes component=apiserver,provider=kubernetes <none> 10.254.0.1 443/TCP

selenium-hub <none> name=selenium-hub 10.254.124.73 4444/TCP

Nadat de service is geïmplementeerd, is deze bereikbaar vanaf:

(via het openbare IP-adres van een ander Kubernetes-knooppunt)

(via het openbare IP-adres van een ander Kubernetes-knooppunt)

Firefox-knooppuntreplicatiecontroller:

# selenium-node-firefox-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-firefox

spec:

replicas: 2

selector:

name: selenium-node-firefox

template:

metadata:

labels:

name: selenium-node-firefox

spec:

containers:

- name: selenium-node-firefox

image: selenium/node-firefox

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Implementatie:

Vervang replace_with_service_ipin selenium-node-firefox-rc.yamlmet de feitelijke Selenium hub dienst IP, in dit geval 10.254.124.73.

[root@kube-master ~]# kubectl create -f selenium-node-firefox-rc.yaml

replicationcontrollers/selenium-node-firefox

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-firefox-lc6qt 1/1 Running 0 2m

selenium-node-firefox-y9qjp 1/1 Running 0 2m

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-lc6qt

Name: selenium-node-firefox-lc6qt

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node2/45.63.16.92

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.101.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:37 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-lc6qt to kube-node2

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD created Created with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node2} implicitly required container POD started Started with docker id cdcb027c6548

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers pulled Successfully pulled image "selenium/node-firefox"

Sat, 24 Oct 2015 17:08:36 +0000 Sat, 24 Oct 2015 17:08:36 +0000 1 {kubelet kube-node2} spec.containers created Created with docker id 8931b7f7a818

Sat, 24 Oct 2015 17:08:37 +0000 Sat, 24 Oct 2015 17:08:37 +0000 1 {kubelet kube-node2} spec.containers started Started with docker id 8931b7f7a818

[root@kube-master ~]# kubectl describe pod selenium-node-firefox-y9qjp

Name: selenium-node-firefox-y9qjp

Namespace: default

Image(s): selenium/node-firefox

Node: kube-node1/185.92.221.67

Labels: name=selenium-node-firefox

Status: Running

Reason:

Message:

IP: 10.20.92.3

Replication Controllers: selenium-node-firefox (2/2 replicas created)

Containers:

selenium-node-firefox:

Image: selenium/node-firefox

State: Running

Started: Sat, 24 Oct 2015 17:08:13 +0000

Ready: True

Restart Count: 0

Conditions:

Type Status

Ready True

Events:

FirstSeen LastSeen Count From SubobjectPath Reason Message

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {scheduler } scheduled Successfully assigned selenium-node-firefox-y9qjp to kube-node1

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD pulled Pod container image "gcr.io/google_containers/pause:0.8.0" already present on machine

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD created Created with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} implicitly required container POD started Started with docker id ea272dd36bd5

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers created Created with docker id 6edbd6b9861d

Sat, 24 Oct 2015 17:08:13 +0000 Sat, 24 Oct 2015 17:08:13 +0000 1 {kubelet kube-node1} spec.containers started Started with docker id 6edbd6b9861d

Zoals we kunnen zien, heeft Kubernetes 2 replica's gemaakt selenium-firefox-nodeen verspreid over het cluster. Pod selenium-node-firefox-lc6qtbevindt zich op kube-node2, terwijl pod selenium-node-firefox-y9qjpzich op kube-node1 bevindt.

We herhalen hetzelfde proces voor onze Selenium Chrome-knooppunten.

Chrome-knooppuntreplicatiecontroller:

# selenium-node-chrome-rc.yaml

apiVersion: v1

kind: ReplicationController

metadata:

name: selenium-node-chrome

labels:

app: selenium-node-chrome

spec:

replicas: 2

selector:

app: selenium-node-chrome

template:

metadata:

labels:

app: selenium-node-chrome

spec:

containers:

- name: selenium-node-chrome

image: selenium/node-chrome

ports:

- containerPort: 5900

env:

- name: HUB_PORT_4444_TCP_ADDR

value: "replace_with_service_ip"

- name: HUB_PORT_4444_TCP_PORT

value: "4444"

Implementatie:

[root@kube-master ~]# kubectl create -f selenium-node-chrome-rc.yaml

replicationcontrollers/selenium-node-chrome

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 2

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 1m

selenium-node-chrome-mgi52 1/1 Running 0 1m

selenium-node-firefox-lc6qt 1/1 Running 0 11m

selenium-node-firefox-y9qjp 1/1 Running 0 11m

In deze handleiding hebben we een klein Kubernetes-cluster van 3 servers opgezet (1 mastercontroller + 2 workers).

Met behulp van pods, RC's en een service hebben we met succes een Selenium Grid geïmplementeerd, bestaande uit een centrale hub en 4 knooppunten, waardoor ontwikkelaars 4 gelijktijdige Selenium-tests tegelijk op het cluster kunnen uitvoeren.

Kubernetes heeft de containers automatisch gepland in het hele cluster.

Kubernetes verplaatst pods automatisch opnieuw naar gezonde servers als een of meer van onze servers uitvallen. In mijn voorbeeld draait kube-node2 momenteel de Selenium hub pod en 1 Selenium Firefox node pod.

[root@kube-node2 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5617399f146c selenium/node-firefox "/opt/bin/entry_poin 5 minutes ago Up 5 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_baae8e00

185230a3b431 gcr.io/google_containers/pause:0.8.0 "/pause" 5 minutes ago Up 5 minutes k8s_POD.3805e8b7_selenium-node-firefox-zmj1r_default_31c89517-7a75-11e5-8648-5600001611e0_40f809df

fdd5834c249d selenium/hub "/opt/bin/entry_poin About an hour ago Up About an hour k8s_selenium-hub.cb8bf0ed_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_5765e2c9

00e4ccb0bda8 gcr.io/google_containers/pause:0.8.0 "/pause" About an hour ago Up About an hour k8s_POD.3b3ee8b9_selenium-hub-pilc8_default_6c98c1ff-7a68-11e5-8648-5600001611e0_8398ac33

We simuleren serverstoringen door kube-node2 uit te schakelen. Na een paar minuten zou je moeten zien dat de containers die op kube-node2 draaiden, zijn verplaatst naar kube-node1, waardoor de service minimaal wordt verstoord.

[root@kube-node1 ~]# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5bad5f582698 selenium/hub "/opt/bin/entry_poin 19 minutes ago Up 19 minutes k8s_selenium-hub.cb8bf0ed_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_ccaad50a

dd1565a94919 selenium/node-firefox "/opt/bin/entry_poin 20 minutes ago Up 20 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_fc79f977

2be1a316aa47 gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3805e8b7_selenium-node-firefox-g28z5_default_fe932673-7a76-11e5-8648-5600001611e0_dc204ad2

da75a0242a9e gcr.io/google_containers/pause:0.8.0 "/pause" 20 minutes ago Up 20 minutes k8s_POD.3b3ee8b9_selenium-hub-hycf2_default_fe9057cf-7a76-11e5-8648-5600001611e0_1b10c0e7

c611b68330de selenium/node-firefox "/opt/bin/entry_poin 33 minutes ago Up 33 minutes k8s_selenium-node-firefox.46e635d8_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_922af821

828031da6b3c gcr.io/google_containers/pause:0.8.0 "/pause" 33 minutes ago Up 33 minutes k8s_POD.3805e8b7_selenium-node-firefox-8ylo2_default_31c8a8f3-7a75-11e5-8648-5600001611e0_289cd555

caf4e725512e selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_3c6e855a

409a20770787 selenium/node-chrome "/opt/bin/entry_poin 46 minutes ago Up 46 minutes k8s_selenium-node-chrome.362a34ee_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_ac3f0191

7e2d942422a5 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-9u1ld_default_392a15a4-7a73-11e5-8648-5600001611e0_f5858b73

a3a65ea99a99 gcr.io/google_containers/pause:0.8.0 "/pause" 47 minutes ago Up 47 minutes k8s_POD.3805e8b7_selenium-node-chrome-mgi52_default_392a2647-7a73-11e5-8648-5600001611e0_20a70ab6

Het schalen van je Selenium Grid is super eenvoudig met Kubernetes. Stel je voor dat ik in plaats van 2 Firefox-knooppunten 4 zou willen uitvoeren. Het opschalen kan worden gedaan met een enkele opdracht:

[root@kube-master ~]# kubectl scale rc selenium-node-firefox --replicas=4

scaled

[root@kube-master ~]# kubectl get rc

CONTROLLER CONTAINER(S) IMAGE(S) SELECTOR REPLICAS

selenium-hub selenium-hub selenium/hub name=selenium-hub 1

selenium-node-chrome selenium-node-chrome selenium/node-chrome app=selenium-node-chrome 2

selenium-node-firefox selenium-node-firefox selenium/node-firefox name=selenium-node-firefox 4

[root@kube-master ~]# kubectl get pods

NAME READY STATUS RESTARTS AGE

selenium-hub-pilc8 1/1 Running 1 1h

selenium-node-chrome-9u1ld 1/1 Running 0 14m

selenium-node-chrome-mgi52 1/1 Running 0 14m

selenium-node-firefox-8ylo2 1/1 Running 0 40s

selenium-node-firefox-lc6qt 1/1 Running 0 24m

selenium-node-firefox-y9qjp 1/1 Running 0 24m

selenium-node-firefox-zmj1r 1/1 Running 0 40s

Gebruikt u een ander systeem? Introductie CyberPanel is een van de eerste bedieningspanelen op de markt die zowel open source is als OpenLiteSpeed gebruikt. Wat thi

Introductie Sensu is een gratis en open source monitoringoplossing die kan worden gebruikt om server, applicatie en verschillende systeemservices te monitoren. Sensu i

Het gebruik van een sudo-gebruiker om toegang te krijgen tot een server en opdrachten uit te voeren op rootniveau is een veel voorkomende praktijk onder Linux en Unix-systeembeheerder. Het gebruik van een sud

Gebruikt u een ander systeem? RTMP is geweldig voor het weergeven van live inhoud. Wanneer RTMP is gekoppeld aan FFmpeg, kunnen streams worden omgezet in verschillende kwaliteiten. Vultr ik

TaskBoard is een gratis en open source webbeheer voor tijdbeheer. Geïnspireerd door Kanban, kan TaskBoard u helpen bij het bijhouden van dingen die moeten worden gedaan in een

Gebruikt u een ander systeem? Gradle is een gratis en open source toolset voor het automatiseren van builds, gebaseerd op de concepten van Apache Ant en Apache Maven. Gradle biedt

Gebruikt u een ander systeem? In deze handleiding zullen we zien hoe u een FTP-server (ProFTPd) configureert om bestanden over te zetten tussen uw pc en uw server.

Gebruikt u een ander systeem? Netdata is een rijzende ster op het gebied van realtime monitoring van systeemstatistieken. Vergeleken met andere tools van dezelfde soort, Netdata:

Gebruikt u een ander systeem? Apache Cassandra is een gratis en open source NoSQL-databasebeheersysteem dat is ontworpen om schaalbaarheid te bieden

In deze tutorial leer je goed hoe je een Just Cause 2 multiplayer-server opzet. Vereisten Zorg ervoor dat het systeem volledig is bijgewerkt voordat we beginnen

Gebruikt u een ander systeem? In deze tutorial leg ik uit hoe je een Starbound-server instelt op CentOS 7. Vereisten Je moet dit spel op je hebben

ZNC is een gratis en open-source IRC-uitsmijter die permanent verbonden blijft met een netwerk, zodat klanten berichten kunnen ontvangen die worden verzonden terwijl ze offline zijn. Thi

Django is een populair Python-framework voor het schrijven van webapplicaties. Met Django kun je sneller applicaties bouwen, zonder het wiel opnieuw uit te vinden. Als je wilt

MantisBT, of Mantis Bug Tracker, is een open source issue tracker geschreven in PHP. MantisBT is uitgebalanceerd tussen gebruiksgemak en functionaliteit, mits

Gebruikt u een ander systeem? Elgg is een open source engine voor sociaal netwerken waarmee sociale omgevingen kunnen worden gecreëerd, zoals sociale campusnetwerken

Froxlor is een open source, gratis, lichtgewicht en toch krachtig serverbeheerpaneel dat geweldig is voor het opzetten en beheren van webhostingservices. Thi

Gebruikt u een ander systeem? Alfresco Community Edition is een open source-versie van de Alfresco Content Services. Het is geschreven in Java en gebruikt PostgreSQL t

Vtiger CRM is een populaire applicatie voor klantrelatiebeheer die bedrijven kan helpen hun verkoop te laten groeien, klantenservice te bieden en de winst te vergroten. ik

Wat je nodig hebt Een Vultr VPS met minimaal 1 GB RAM. SSH-toegang (met root- / beheerdersrechten). Stap 1: BungeeCord installeren Eerste dingen eerst

MaraDNS is een lichtgewicht maar robuust open source DNS-serverprogramma. Vergeleken met andere applicaties van dezelfde soort, zoals ISC BIND, PowerDNS en djbdns

Ransomware-aanvallen nemen toe, maar kan AI helpen het nieuwste computervirus het hoofd te bieden? Is AI het antwoord? Lees hier weten is AI boezem of vloek

ReactOS, een open source en gratis besturingssysteem is hier met de nieuwste versie. Kan het voldoen aan de behoeften van moderne Windows-gebruikers en Microsoft uitschakelen? Laten we meer te weten komen over deze oude stijl, maar een nieuwere OS-ervaring.

WhatsApp heeft eindelijk de Desktop-app voor Mac- en Windows-gebruikers gelanceerd. Nu heb je eenvoudig toegang tot WhatsApp vanuit Windows of Mac. Beschikbaar voor Windows 8+ en Mac OS 10.9+

Lees dit om te weten hoe kunstmatige intelligentie populair wordt onder de kleinschalige bedrijven en hoe het de kansen vergroot om ze te laten groeien en hun concurrenten voorsprong te geven.

Onlangs heeft Apple macOS Catalina 10.15.4 uitgebracht, een aanvullende update om problemen op te lossen, maar het lijkt erop dat de update meer problemen veroorzaakt die ertoe leiden dat mac-machines worden gemetseld. Lees dit artikel voor meer informatie

13 Commerciële data-extractietools voor big data

Onze computer slaat alle gegevens op een georganiseerde manier op, het zogenaamde Journaling-bestandssysteem. Het is een efficiënte methode waarmee de computer bestanden kan zoeken en weergeven zodra u op zoeken drukt.https://wethegeek.com/?p=94116&preview=true

Naarmate de wetenschap zich snel ontwikkelt en veel van onze inspanningen overneemt, nemen ook de risico's toe om onszelf te onderwerpen aan een onverklaarbare singulariteit. Lees, wat singulariteit voor ons kan betekenen.

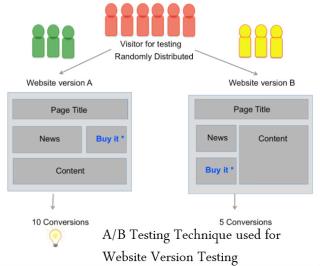

Een inzicht in 26 Big Data-analysetechnieken: deel 1

AI in de zorg heeft de afgelopen decennia grote sprongen gemaakt. De toekomst van AI in de gezondheidszorg groeit dus nog steeds met de dag.