Gezichtsherkenningstechnologie en zijn mogelijkheden zijn onze verbeelding ver te boven gegaan sinds nieuwe algoritmen om deze technologie bij wetshandhaving te versterken op de voorgrond zijn gekomen. Momenteel wordt gezichtsherkenningstechnologie gebruikt door wetshandhavers op de laagste niveaus van gegevensverzamelingsprocessen om criminele overtreders te identificeren te midden van drukke bijeenkomsten. De techneut gebruikt beelden van CCTV-camera's op openbare plaatsen en straten en voert de verzamelde gegevens vervolgens uit in archieven van instanties om een gezicht te detecteren dat wordt gezocht voor strafbare feiten.

Deze technologie is verder ingebed in de kleinste gadgets, waaronder mobiele telefoons en slimme draagbare apparaten. Daarom beschermt het u niet alleen op straat, maar is het ook van plan uw persoonlijke informatie die op uw slimme apparaten is opgeslagen te beschermen. Het gebruik van "faceprint" voor marketing- en reclamepraktijken is gebruikelijk geworden in de moderne tijd van campagnes op sociale media. En dan is er nog de privébewaking in winkelcentra, winkels, enz.

Vanuit dit perspectief kan men snel wijzen op de onmiskenbare voordelen van gezichtsherkenningstechnologie. Maar het is ook onderzocht vanwege de bedreiging die het vormt voor de privacy van gebruikers, gegevensbescherming en natuurlijk de transparantie tussen de wet en het publiek. Het is een goede zaak om op de hoogte te zijn van zowel de voor- als nadelen van zo'n invasieve technologie. Toch is er nog een nadeel van de gezichtsherkenningstechnologie, die mensen lijken te negeren, en dat is raciale profilering en rassendiscriminatie .

In dit stuk bekijken we hoe deze technologie raciale vooroordelen en discriminatie bevordert en hoe ernstig de gevolgen van dergelijke invasieve technologie zijn.

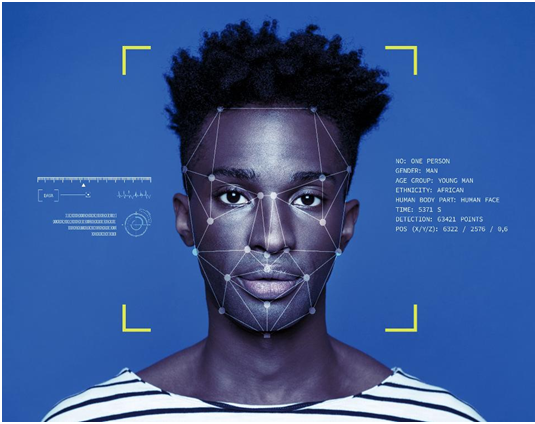

Hoe gezichtsherkenning werkt?

Afbeeldingsbron: National Post

Stap 1: Er wordt een foto van jou gemaakt van een camera, je account, e-mail, enz. Het is een gewone profielfoto of een willekeurige foto in een menigte.

Stap 2: De gezichtsherkenningssoftware leidt uw gezicht door een database met opgeslagen gezichtsafdrukken. De gezichtsafdruk wordt verzameld via geometrische tracking van je gezicht.

Stap 3: Een matchpercentage van uw foto met een bekende gezichtsafdruk wordt geproduceerd met behulp van een algoritme waarover een bepaling wordt gemaakt.

Automatiseringsbias: een van de vele tekortkomingen van gezichtsherkenningstechnologie

Automatiseringsbias of machinebias verwijst naar het scenario waarin een machinealgoritme een zekere vooringenomenheid vertoont bij de kalibratie van de invoergegevens, waardoor een ongunstige uitvoer wordt verkregen. Dit gebeurt wanneer er een fout zit in de algoritmecode, gebrek aan opgeslagen datasets voor kalibratie, onjuiste invoerwaarden of overmatige invoergegevens, die de machine niet kan kalibreren.

Hoe gaat raciale profilering hiermee gepaard?

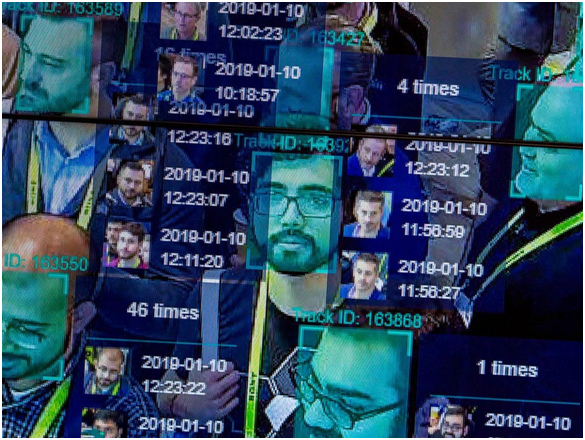

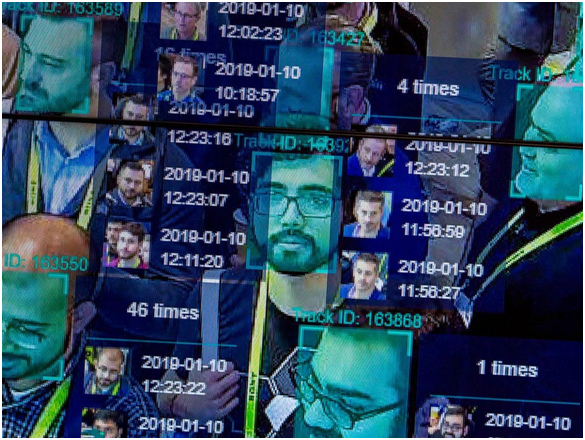

Afbeeldingsbron: The Guardian

Laten we beginnen met een oud incident dat destijds als onbeduidend werd beschouwd. In 2001 gebruikte Tampa City gezichtsherkenningssoftware voor bewaking van de drukke stad toen toeristen de straten van de stad overspoelden als gevolg van de Super Bowl van 2001. Volgens een rapport van de New York Times identificeerde de software 19 mensen die zogenaamd uitstaande arrestatiebevelen tegen hen hadden; er werden echter geen arrestaties verricht omdat de infrastructuur van het stadion het onmogelijk maakte om de geïdentificeerde daders onder een overweldigende menigte te bereiken.

Hoewel in dit specifieke geval nergens tekenen van raciale profilering werden waargenomen, was het de eerste keer dat bewakingstechnieken werden ingezet tegen de schending van burgerlijke vrijheden en privacy van individuen. In de komende jaren gaf de politie van Tampa deze bewakingssystemen op en noemde onbetrouwbare resultaten.

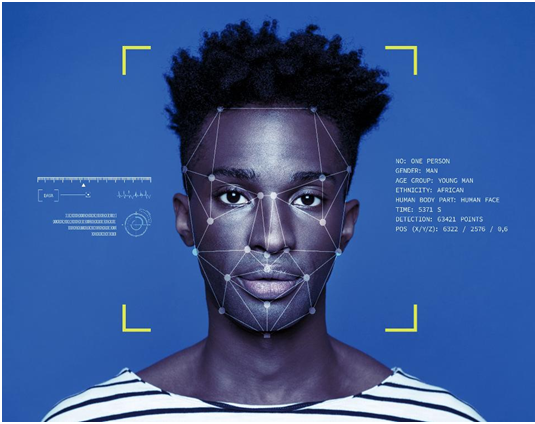

Afbeeldingsbron: ICO

Snel vooruitspoelend naar een wat recenter scenario, rapporteerde Ali Breland voor The Guardian , over een arrestatie van Willie Lynch, een zwarte man die ervan wordt beschuldigd een beruchte drugsdealer te zijn in de omgeving van Brentwood, voornamelijk een buurt van gekleurde mensen. Het enige bewijs tegen Lynch waren zijn foto's op een mobiel, die werden vergeleken met een politiedatabase voordat de politie hem als de boosdoener vaststelde. Lynch werd voor acht jaar veroordeeld, die nu in beroep is gegaan tegen de veroordeling. Of hij nu de vermeende dealer was of niet, het roept onvermijdelijk bezorgdheid op over de vraag of alleen een machinegebaseerd resultaat voldoende is om de veroordeling van iemand die wordt onderzocht te handhaven.

In 2019, zoals gerapporteerd door Tom Perkins voor The Guardian , werd de politie van Detroit gevonden die gezichtsherkenning gebruikte om naar verluidt de afgelopen twee jaar arrestaties te verrichten. Detroit is een plaats waar meer dan 80% van de bevolking zwart is. Een verklaring van een zwart lid van de politiecommissie van Detroit wekte bezorgdheid op tegen de praktijk. Hij zei dat zwarte mensen een gemeenschappelijk gezichtskenmerk hebben dat het algoritme van het systeem in gevaar brengt, en noemde dit 'technoracisme'.

Afbeeldingsbron: Vox

In een onderzoek uit 2019 voor de Journal of Information Communication and Ethics Society, door Fabio Bacchini en Ludovica Lorusso, werd vastgesteld dat deze biometrische en gezichtsherkenningssystemen niet 100% betrouwbaar zijn voor wetshandhavers. Bovendien had rassendiscriminatie een negatief effect op al dergelijke systemen, wat nog meer omgekeerde maatschappelijke implicaties heeft. Het onderzoek richtte zich met name op westerse samenlevingen, waar dergelijke systemen op grote schaal worden gebruikt voor surveillance.

Dit zijn slechts drie van de vele voorbeelden waarin gevallen van raciale ongelijkheden die worden veroorzaakt door gezichtsherkenningssystemen aan het licht zijn gekomen. Maar waarom zijn deze systemen zo incompetent ondanks zo'n groeiende nauwkeurigheid in algoritmische coderingsupgrades in technologie.

Witte suprematie in de westerse staten: een blanke dominante technische industrie

In 2014 bleek een meerderheid van de technologiebedrijven, waaronder het gigantische Apple Inc., voornamelijk blanke, mannelijke werknemers aan te nemen. Bij Apple was 55% van de werknemers blank, en op dezelfde manier bestond het leiderschap van Apple uit 63% van de blanke werknemers. De bedrijven die vergelijkbare diversiteitsrapporten deelden, waren ook Facebook , Google en Twitter. Vijf jaar later onthulde een rapport in Wired dat deze cijfers minimaal waren verbeterd.

Hoewel Facebook een behoorlijke verbetering in aantal liet zien, bleef het percentage zwarte technische werknemers van Apple onveranderd op slechts 6% van het totale personeelsbestand. Amazon was de enige organisatie die 42% zwarte of Latijns-Amerikaanse arbeiders registreerde in zijn Amerikaanse kantoren.

Wat betekenen deze statistieken? In de VS zijn de meeste codeurs, die zijn toegewezen aan grote projecten, zoals het ontwerpen van algoritmen voor bewakingssystemen, blank. Dit zijn de mensen die de belangrijkste beslissingen nemen met betrekking tot een product of dienst die door een bedrijf moet worden gelanceerd/ontsluierd. En daarom zijn het hun perspectieven, benadering en denkprocessen die meespelen in de uiteindelijke creatie. Dit wil niet zeggen dat blanke mensen racisten zijn en met opzet dergelijke bewakingssystemen hebben ontworpen . NEE!

Afbeeldingsbron: Forbes

Wanneer een blanke een algoritme voor gezichtsherkenning ontwerpt en alleen blanke collega's heeft die hem adviseren/bijstaan, houden ze geen rekening met de gezichtskenmerken van mensen met een andere kleur voordat ze de code hebben voltooid. Omdat blanke ingenieurs de technische industrie domineren, worden de gegevensarchieven die worden gebruikt om de eerste code voor te bereiden, ook gemaakt en gekalibreerd door blanke technici. De code zelf is dus gemaakt met een vooroordeel in het belangrijkste rekenalgoritme, wat resulteert in deze raciale verschillen in bewakingsresultaten.

De code leert eenvoudig wat blanken erin belichamen. Er is geen perspectief of bijdrage van een persoon van een andere kleur.

De kalibratieproblemen

De Amerikaanse wetshandhaving is sterk afhankelijk van surveillance en datatracking. Er zijn veel gevallen geweest waarin klokkenluiders informatie over ongeoorloofd toezicht op burgers verdrongen. Edward Snowdens onthulling van het illegale toezicht door de NSA is daar een voorbeeld van.

Afbeeldingsbron: CBS Local

Deze bewakingsprogramma's worden ondersteund door gezichtsafdrukken en andere persoonlijke informatie van miljoenen burgers. Als we alleen naar gezichtsafdrukken kijken, zijn er miljoenen Amerikanen die openlijk foto's delen op sociale-mediaplatforms. Dan zijn er CCTV-camera's in elke straat van het land die live beelden bieden van honderdduizenden voorbijgangers. Momenteel zijn er ongeveer 117 miljoen afbeeldingen in politiedatabases, terwijl de FBI meer dan 400 miljoen datasets heeft om te kalibreren in algoritmen voor gezichtsherkenning.

Stel je nu eens voor dat deze datasets worden vergeleken met een enkele afbeelding die al dan niet alle gezichtskenmerken van de specifieke persoon heeft vastgelegd. In een dergelijk scenario zullen er waarschijnlijk fouten optreden. Er zijn gewoon te veel gegevens om te begrijpen en te vergelijken met één gezichtsafdruk. Geen enkel algoritme kan honderd procent zekerheid in het resultaat garanderen als de kalibratie zo ingewikkeld is. Dit komt uiteindelijk neer op de raciale profilering die wordt veroorzaakt door gezichtsherkenningstechnologie.

De enorme betrouwbaarheid van gezichtsherkenning

Afbeeldingsbron: NY Post

De zaak van Willie Lynch herinnert ons eraan dat gezichtsherkenning niet de enige betrouwbare techniek mag zijn die als bewijs wordt gepresenteerd als het gaat om rechtshandhaving. Dit is de reden waarom de stadspolitie van Tampa de technologie opgaf.

Het is waar dat gezichtsherkenning een uitstekend resort is en behulpzaam is voor de politie. De daders van de bomaanslagen tijdens de marathon van Boston werden herkend aan de hand van uitgebreide en gedetailleerde analyses van bewakingsopnamen. Maar dit kan niet het enige bewijs zijn om iemand te veroordelen. Er moet ondersteunend bewijs zijn om de resultaten van de gezichtsherkenningsalgoritmen te bewijzen, en het concept van automatiseringsbias moet worden overwogen voordat een definitieve beslissing wordt genomen.

Het hardwareprobleem: gezichtsherkenning op mobiel en camera's

Afbeeldingsbron: TechCrunch

De bewakingscamerasystemen en bijbehorende hard- en software zijn niet door één bedrijf ontworpen. Het is een industrie die miljarden dollars waard is, waarin tientallen bedrijven strijden om contracten van wetshandhavingsinstanties. Veel van deze systemen zijn van Chinese fabrikanten. Het draait allemaal om de goedkoopste technologie met de beste kwaliteiten. Zo werkt het meestal. En daarom zijn er altijd kansen op verschillen in kalibratie van verschillende systemen, evenals variatie in de kwaliteit van bewakingsresultaten. Veel algoritmen voor camerabewaking zijn niet effectief in het kalibreren van afbeeldingen van gekleurde mensen, alleen vanwege technische incompetentie, waardoor rassendiscriminatie wordt verheerlijkt.

De technische problemen die racisme veroorzaken via gezichtsherkenning zijn ook opgemerkt in de Apple Face Lock-functie. Een zaak uit China zorgde ervoor dat de gezichtsvergrendeling van de iPhone X geen onderscheid kon maken tussen twee verschillende Chinese collega's, waardoor de functie nutteloos werd. Soortgelijke rapporten werden afgewezen, daarbij verwijzend naar problemen in de functie bij het scheiden van twee zwarte mensen van elkaar. Zoals hierboven vermeld, heeft Apple slechts 6% zwarte mensen in technische teams. Het is een duidelijk voorbeeld van hoe een technologie voor gezichtsherkenning racisme kan promoten, zelfs op onze draagbare apparaten.

Conclusie

Ja, gezichtsherkenning is racistisch, en dat is nu algemeen bekend. Hoewel de technologie dagelijks groeit om dergelijke problemen op te lossen, zijn de resultaten hetzelfde. Technologie wordt verondersteld de wereld te verenigen over gemeenschappelijke doelen van technische vooruitgang en ontwikkeling, maar sommige technieken brengen alleen maar schade toe aan raciale en gemeenschappelijke harmonie.

Voorlopig is het beste wat wetshandhavers kunnen doen, hun zaken niet te ondersteunen op basis van bewijs van algoritmische kalibraties, die niet eens betrouwbaar zijn. Bovendien is het de hoogste tijd dat diversiteit en inclusie op de werkvloer serieus wordt genomen, zodat mensen van alle etnische groepen kunnen samenkomen om een product te creëren dat vrij is van raciale ongelijkheden. Er zijn duizenden rassen in de wereld, en mensen zijn gegroeid om de raciale verschillen opzij te zetten, die de mondiale samenleving zo lang achtervolgden. Als dat moet worden volgehouden, dan moeten de machines waarop we ons zoveel vertrouwen, hetzelfde worden geleerd.