Funkcjonalności warstw architektury referencyjnej Big Data

Przeczytaj blog, aby w najprostszy sposób poznać różne warstwy w architekturze Big Data i ich funkcjonalności.

Apache Hadoop to otwarte narzędzie do przetwarzania Big Data, szeroko stosowane w branży IT.

W zależności od rozmiaru, typu i skali danych można wdrożyć Hadoop w trybie autonomicznym lub w trybie klastra.

W tym samouczku dla początkujących zainstalujemy Hadoop w trybie autonomicznym na instancji serwera CentOS 7.

Zaloguj się jako użytkownik sudo, a następnie zaktualizuj system CentOS 7 do najnowszej stabilnej wersji:

sudo yum install epel-release -y

sudo yum update -y

sudo shutdown -r now

Gdy serwer będzie w trybie online, zaloguj się ponownie.

Hadoop jest oparty na Javie, a OpenJDK 8 jest zalecaną wersją dla najnowszej stabilnej wersji.

Zainstaluj OpenJDK 8 JRE za pomocą YUM:

sudo yum install -y java-1.8.0-openjdk

Sprawdź instalację OpenJDK 8 JRE:

java -version

Dane wyjściowe powinny przypominać:

openjdk version "1.8.0_111"

OpenJDK Runtime Environment (build 1.8.0_111-b15)

OpenJDK 64-Bit Server VM (build 25.111-b15, mixed mode)

Zawsze możesz znaleźć adres URL pobierania najnowszej wersji Hadoop na oficjalnej stronie wydania Apache Hadoop . W chwili pisania tego artykułu najnowsza stabilna wersja Hadoop to 2.7.3.

Pobierz archiwum binarne Hadoop 2.7.3:

cd

wget http://www-us.apache.org/dist/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz

Pobierz pasujący plik sumy kontrolnej:

wget https://dist.apache.org/repos/dist/release/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz.mds

Zainstaluj narzędzie sumy kontrolnej:

sudo yum install perl-Digest-SHA

Oblicz wartość SHA256 archiwum Hadoop:

shasum -a 256 hadoop-2.7.3.tar.gz

Wyświetl zawartość pliku hadoop-2.7.3.tar.gz.mdsi upewnij się, że dwie wartości SHA256 są identyczne:

cat hadoop-2.7.3.tar.gz.mds

Rozpakuj archiwum do wyznaczonej lokalizacji:

sudo tar -zxvf hadoop-2.7.3.tar.gz -C /opt

Zanim będzie można poprawnie uruchomić Hadoop, musisz określić jego lokalizację główną Java.

Otwórz plik konfiguracyjny środowiska Hadoop /opt/hadoop-2.7.3/etc/hadoop/hadoop-env.shza pomocą vilub ulubionego edytora tekstu:

sudo vi /opt/hadoop-2.7.3/etc/hadoop/hadoop-env.sh

Znajdź linię:

export JAVA_HOME=$

Zamień na:

export JAVA_HOME=$(readlink -f /usr/bin/java | sed "s:bin/java::")

To ustawienie sprawi, że Hadoop zawsze będzie używać domyślnej lokalizacji instalacji Java.

Zapisz i wyjdź:

:wq!

PATHDla wygody możesz dodać ścieżkę programu Hadoop do zmiennej środowiskowej:

echo "export PATH=/opt/hadoop-2.7.3/bin:$PATH" | sudo tee -a /etc/profile

source /etc/profile

Wystarczy wykonać polecenie hadoop, a zostaniesz poproszony o użycie polecenia hadoop i jego różnych parametrów.

Tutaj możesz użyć wbudowanego przykładu do przetestowania instalacji Hadoop.

Przygotuj źródło danych:

mkdir ~/source

cp /opt/hadoop-2.7.3/etc/hadoop/*.xml ~/source

Użyj Hadoop razem z grep, aby wyświetlić wynik:

hadoop jar /opt/hadoop-2.7.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.3.jar grep ~/source ~/output 'principal[.]*'

Dane wyjściowe powinny być:

...

File System Counters

FILE: Number of bytes read=1247812

FILE: Number of bytes written=2336462

FILE: Number of read operations=0

FILE: Number of large read operations=0

FILE: Number of write operations=0

Map-Reduce Framework

Map input records=2

Map output records=2

Map output bytes=37

Map output materialized bytes=47

Input split bytes=117

Combine input records=0

Combine output records=0

Reduce input groups=2

Reduce shuffle bytes=47

Reduce input records=2

Reduce output records=2

Spilled Records=4

Shuffled Maps =1

Failed Shuffles=0

Merged Map outputs=1

GC time elapsed (ms)=24

Total committed heap usage (bytes)=262758400

Shuffle Errors

BAD_ID=0

CONNECTION=0

IO_ERROR=0

WRONG_LENGTH=0

WRONG_MAP=0

WRONG_REDUCE=0

File Input Format Counters

Bytes Read=151

File Output Format Counters

Bytes Written=37

Na koniec możesz wyświetlić zawartość plików wyjściowych:

cat ~/output/*

Wynik powinien być:

6 principal

1 principal.

Jesteś teraz gotowy do odkrywania Hadoop.

Przeczytaj blog, aby w najprostszy sposób poznać różne warstwy w architekturze Big Data i ich funkcjonalności.

Chcesz zobaczyć rewolucyjne wynalazki Google i jak te wynalazki zmieniły życie każdego człowieka dzisiaj? Następnie czytaj na blogu, aby zobaczyć wynalazki Google.

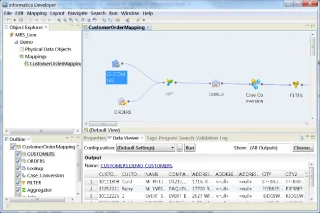

13 komercyjnych narzędzi do ekstrakcji danych z Big Data

Whatsapp w końcu uruchomił aplikację Desktop dla użytkowników komputerów Mac i Windows. Teraz możesz łatwo uzyskać dostęp do Whatsapp z systemu Windows lub Mac. Dostępne dla Windows 8+ i Mac OS 10.9+

Energia jądrowa jest zawsze pogardzana, nigdy jej nie szanujemy z powodu przeszłych wydarzeń, ale nie zawsze jest zła. Przeczytaj post, aby dowiedzieć się więcej na ten temat.

Koncepcja autonomicznych samochodów, które wyjadą na drogi za pomocą sztucznej inteligencji, to marzenie, które mamy już od jakiegoś czasu. Ale pomimo kilku obietnic nigdzie ich nie widać. Przeczytaj ten blog, aby dowiedzieć się więcej…

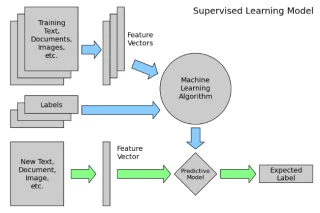

Sztuczna inteligencja nie jest dla ludzi nową nazwą. Ponieważ sztuczna inteligencja jest włączona do każdego strumienia, jednym z nich jest opracowywanie narzędzi zwiększających ludzką wydajność i dokładność. Skorzystaj z tych niesamowitych narzędzi uczenia maszynowego i uprość swoje codzienne zadania.

Wzrasta liczba ataków ransomware, ale czy sztuczna inteligencja może pomóc w radzeniu sobie z najnowszym wirusem komputerowym? Czy AI jest odpowiedzią? Przeczytaj tutaj, wiedz, że sztuczna inteligencja jest zmorą lub zgubą

Zawsze potrzebujemy Big Data Analytics do efektywnego zarządzania danymi. W tym artykule omówiliśmy kilka technik analizy Big Data. Sprawdź ten artykuł.

Czy jesteś również ofiarą ataków DDOS i nie masz pewności co do metod zapobiegania? Przeczytaj ten artykuł, aby rozwiązać swoje pytania.