Как использовать Chat GPT для Power BI: это просто!

Как использовать Chat GPT для Power BI: это просто!

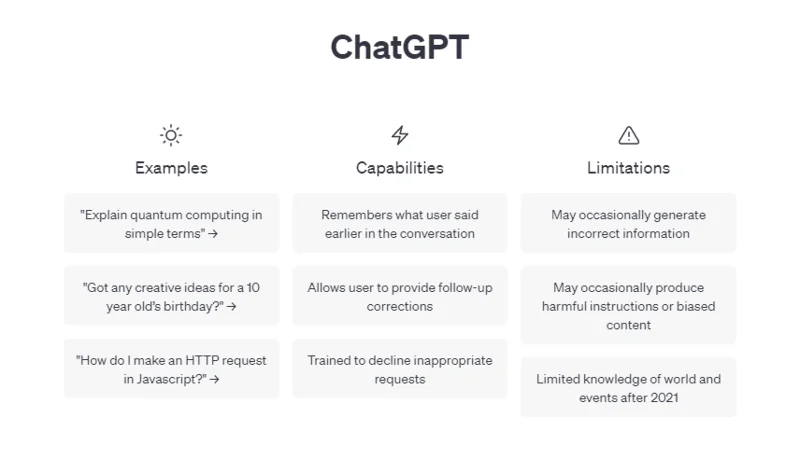

ChatGPT значительно вырос с момента своего публичного выпуска в ноябре 2022 года. Он стал важным инструментом для многих компаний и частных лиц, но по мере того, как технология все больше интегрируется в нашу повседневную жизнь, естественно задаться вопросом: безопасно ли использовать ChatGPT?

ChatGPT обычно считается безопасным для использования благодаря многочисленным мерам безопасности, методам обработки данных и политикам конфиденциальности, реализованным его разработчиками. Однако, как и любая технология, ChatGPT не застрахован от проблем безопасности и уязвимостей.

Эта статья поможет вам лучше понять безопасность языковых моделей ChatGPT и AI. Мы рассмотрим различные аспекты, такие как конфиденциальность данных, конфиденциальность пользователей, потенциальные риски, регулирование ИИ и меры безопасности.

К концу вы получите более глубокое понимание безопасности ChatGPT и будете лучше подготовлены для принятия обоснованных решений при использовании этой мощной модели большого языка.

Давайте начнем!

Оглавление

Безопасно ли использовать ChatGPT?

Да, использовать Chat GPT безопасно. Чат-бот с искусственным интеллектом и его архитектура генеративного предварительно обученного преобразователя (GPT) были разработаны Open AI для безопасной генерации ответов на естественном языке и высококачественного контента таким образом, чтобы он звучал как человек.

OpenAI внедрил надежные меры безопасности и методы обработки данных для обеспечения безопасности пользователей. Давайте разберем это:

1. Меры безопасности

Способность ChatGPT генерировать ответы на естественном языке, несомненно, впечатляет, но насколько это безопасно? Вот примеры некоторых мер со страницы безопасности Open AI :

Шифрование . Серверы Chat GPT используют шифрование как при хранении, так и при передаче, чтобы защитить пользовательские данные от несанкционированного доступа. Ваши данные шифруются при хранении и при передаче между системами.

Контроль доступа : OpenAI реализует строгие механизмы контроля доступа, чтобы гарантировать, что только авторизованный персонал может получить доступ к конфиденциальным пользовательским данным. Это включает в себя использование протоколов аутентификации и авторизации, а также управление доступом на основе ролей.

Внешний аудит безопасности : OpenAI API ежегодно проверяется внешней третьей стороной для выявления и устранения потенциальных уязвимостей в системе. Это помогает гарантировать, что меры безопасности остаются актуальными и эффективными для защиты пользовательских данных.

Программа вознаграждения за обнаружение ошибок . В дополнение к регулярным проверкам OpenAI создала программу вознаграждения за обнаружение ошибок , чтобы побудить этичных хакеров, ученых-исследователей в области безопасности и технических энтузиастов выявлять и сообщать об уязвимостях безопасности.

Планы реагирования на инциденты : OpenAI разработала планы реагирования на инциденты для эффективного управления нарушениями безопасности и сообщения о них в случае их возникновения. Эти планы помогают свести к минимуму влияние любого потенциального нарушения и обеспечить быстрое решение.

Хотя конкретные технические детали мер безопасности OpenAI не разглашаются для поддержания их эффективности, эти примеры демонстрируют приверженность фирмы защите пользовательских данных и безопасности Chat GPT.

2. Практика обработки данных

OpenAI использует ваши разговорные данные для улучшения способности ChatGPT обрабатывать естественный язык. Он следует ответственным методам обработки данных для поддержания доверия пользователей, таким как:

Цель сбора данных : все, что вы вводите в Chat GPT, собирается и сохраняется на серверах OpenAI для улучшения обработки естественного языка системой. OpenAI прозрачен в отношении того, что он собирает и почему. Он использует пользовательские данные в первую очередь для обучения и улучшения языковой модели, а также для улучшения общего пользовательского опыта.

Хранение и хранение данных : OpenAI надежно хранит пользовательские данные и придерживается строгих политик хранения данных. Данные хранятся только до тех пор, пока это необходимо для выполнения их предполагаемой цели. По истечении срока хранения данные либо анонимизируются, либо удаляются для защиты конфиденциальности пользователей.

Обмен данными и участие третьих лиц : ваши данные будут переданы третьим лицам только с вашего согласия или при определенных обстоятельствах, таких как юридические обязательства. OpenAI гарантирует, что третьи стороны, участвующие в обработке данных, придерживаются аналогичных методов обработки данных и стандартов конфиденциальности.

Соблюдение правил : OpenAI соблюдает региональные правила защиты данных в ЕС, Калифорнии и других странах. Это соответствие гарантирует, что их методы обработки данных соответствуют требуемым правовым стандартам конфиденциальности пользователей и защиты данных.

Права пользователя и контроль : вы можете ожидать, что OpenAI будет уважать ваши права в отношении ваших данных. Фирма предоставляет пользователям простой способ доступа, изменения или удаления их личной информации.

OpenAI, кажется, стремится защищать пользовательские данные, но даже при наличии этих мер безопасности вы никогда не должны делиться конфиденциальной информацией с Chat GPT, потому что ни одна система не может гарантировать абсолютную безопасность.

Отсутствие конфиденциальности является большой проблемой при использовании Chat GPT , и это то, что мы подробно рассмотрим в следующем разделе.

Является ли чат GPT конфиденциальным?

Нет, Chat GPT не является конфиденциальным. Chat GPT регистрирует каждый разговор, включая любые личные данные, которыми вы делитесь, и будет использовать их в качестве обучающих данных.

В политике конфиденциальности Open AI говорится, что компания собирает личную информацию, включенную во «ввод, загрузку файлов или отзывы», которые пользователи предоставляют Chat GPT и другим его службам.

В часто задаваемых вопросах компании прямо говорится, что она будет использовать ваши разговоры для улучшения своих языковых моделей ИИ и что ваши чаты могут быть проверены инструкторами по искусственному интеллекту.

В нем также говорится, что OpenAI не может удалять определенные подсказки из вашей истории, поэтому не делитесь личной или конфиденциальной информацией с Chat GPT .

Последствия чрезмерного распространения были освещены в апреле 2023 года, когда местные корейские СМИ сообщили (NB: история на корейском языке, но вырежьте и вставьте ее, как вы уже догадались, в Chat GPT и заставьте ее перевести для вас), что сотрудники Samsung просочились конфиденциальную информацию в Chat GPT как минимум в трех отдельных случаях.

Согласно источнику новостей, двое сотрудников ввели конфиденциальный программный код в Chat GPT для решения и оптимизации кода, а один сотрудник вставил стенограмму корпоративного собрания и запросил протокол.

В ответ на инциденты Samsung объявила, что разрабатывает меры безопасности для предотвращения дальнейших утечек через Chat GPT и может рассмотреть возможность запрета Chat GPT в сети компании, если произойдут аналогичные инциденты.

Хорошей новостью является то, что Chat GPT предоставляет способ удаления ваших чатов, и вы можете настроить его так, чтобы он вообще не сохранял вашу историю. Мы рассмотрим, как это сделать, в следующих двух разделах.

Шаги по удалению ваших чатов на ChatGPT

Чтобы удалить свои разговоры в ChatGPT, выполните следующие действия.

Шаг 1. Выберите разговор, который вы хотите удалить из журнала чата, и щелкните значок корзины, чтобы удалить его.

Шаг 2. Чтобы массово удалить свои разговоры, нажмите на три точки рядом с вашим адресом электронной почты в левом нижнем углу и выберите «Очистить разговоры» в меню.

Вуаля! Твоих чатов больше нет! Вы больше не увидите их, и ChatGPT удалит их из своей системы в течение 30 дней.

Действия, которые помогут ChatGPT не сохранять ваши чаты

Если вы хотите запретить ChatGPT сохранять ваши чаты по умолчанию, выполните следующие действия.

Шаг 1. Откройте меню настроек, нажав на три точки рядом с вашим адресом электронной почты.

Шаг 2. В разделе «Управление данными» отключите переключатель «История чата и обучение».

После снятия флажка ChatGPT больше не будет сохранять новостные чаты в вашей истории и не будет использовать их для обучения модели. Несохраненные разговоры будут удалены из системы в течение месяца.

Теперь, когда вы знаете, как удалить свои чаты и запретить ChatGPT сохранять их по умолчанию, давайте рассмотрим некоторые потенциальные риски использования ChatGPT в следующем разделе.

Каковы потенциальные риски использования ChatGPT?

При оценке безопасности чат-ботов, обученных языковой модели, важно учитывать риски, с которыми могут столкнуться как предприятия, так и частные лица.

Некоторые ключевые проблемы безопасности могут включать утечку данных, несанкционированный доступ к личной информации, а также предвзятую и неточную информацию.

1. Утечки данных

Утечка данных представляет собой потенциальный риск при использовании любого онлайн-сервиса, включая ChatGPT .

Вы не можете загрузить Chat GPT, поэтому вы должны получить к нему доступ через веб-браузеры. В этом контексте утечка данных может произойти, если неавторизованная сторона получит доступ к вашим журналам разговоров, пользовательской информации или другим конфиденциальным данным.

Это может иметь несколько последствий:

Компрометация конфиденциальности : в случае утечки данных ваши личные разговоры, личная информация или конфиденциальные данные могут стать доступными для неавторизованных лиц или организаций, что ставит под угрозу вашу конфиденциальность.

Кража личных данных : киберпреступники потенциально могут использовать раскрытую личную информацию для кражи личных данных или других мошеннических действий, нанося финансовый и репутационный ущерб затронутым пользователям.

Неправомерное использование данных . В случае утечки данных пользовательские данные могут быть проданы или переданы злоумышленникам, которые могут использовать информацию для целевой рекламы, кампаний по дезинформации или других гнусных целей.

Похоже, что OpenAI серьезно относится к кибербезопасности и внедрила различные меры безопасности, чтобы свести к минимуму риск утечки данных.

Однако ни одна система не застрахована от уязвимостей, и реальность такова, что большинство нарушений вызваны человеческими ошибками, а не техническими сбоями.

2. Несанкционированный доступ к конфиденциальной информации

Если сотрудники или отдельные лица вводят конфиденциальную деловую информацию, включая пароли или коммерческую тайну, в ChatGPT, существует вероятность того, что эти данные могут быть перехвачены или использованы злоумышленниками.

Чтобы защитить себя и свой бизнес, рассмотрите возможность разработки общекорпоративной политики использования генеративных технологий искусственного интеллекта.

Несколько крупных компаний уже выпустили предупреждения для сотрудников. Например, Walmart и Amazon, как сообщается, сказали работникам не делиться конфиденциальной информацией с ИИ. Другие, такие как JP Morgan Chase и Verizon, полностью запретили использование ChatGPT.

3. Предвзятая и неточная информация

Еще один риск, связанный с использованием ChatGPT, — это возможность предвзятой или неточной информации.

Из-за большого количества данных, на которых она была обучена, модель ИИ может непреднамеренно генерировать ответы, содержащие ложную информацию или отражающие существующие предубеждения в данных.

Это может вызвать проблемы у компаний, которые полагаются на контент, созданный ИИ, для принятия решений или общения с клиентами.

Вы должны критически оценивать информацию, предоставляемую ChatGPT, чтобы защититься от дезинформации и предотвратить распространение предвзятого контента.

Как вы увидите в следующем разделе, в настоящее время не существует прямых правил, позволяющих свести к минимуму негативное влияние генеративных инструментов искусственного интеллекта, таких как ChatGPT.

Существуют ли правила для ChatGPT и других систем искусственного интеллекта?

В настоящее время нет конкретных правил, которые непосредственно регулируют ChatGPT или другие системы искусственного интеллекта.

Однако технологии искусственного интеллекта, включая ChatGPT, подпадают под действие существующих правил защиты данных и конфиденциальности в различных юрисдикциях. Некоторые из этих правил включают:

Общий регламент по защите данных (GDPR) : GDPR — это комплексный регламент по защите данных, который применяется к организациям, работающим в Европейском союзе (ЕС) или обрабатывающим персональные данные жителей ЕС. Он касается защиты данных, конфиденциальности и прав отдельных лиц в отношении их личных данных.

Закон штата Калифорния о конфиденциальности потребителей (CCPA) : CCPA — это нормативный акт о конфиденциальности данных в Калифорнии, который предоставляет потребителям определенные права в отношении их личной информации. Он требует от компаний раскрывать свои методы сбора и обмена данными и позволяет потребителям отказаться от продажи своей личной информации.

Другие региональные правила. В различных странах и регионах приняты законы о защите данных и конфиденциальности, которые могут применяться к системам искусственного интеллекта, таким как ChatGPT. Примеры включают Закон о защите персональных данных (PDPA) в Сингапуре и Lei Geral de Proteção de Dados (LGPD) в Бразилии. Италия запретила ChatGPT в марте 2023 года из соображений конфиденциальности, но сняла запрет через месяц после того, как OpenAI добавила новые функции безопасности.

Отсутствие конкретных правил, направленных непосредственно на системы ИИ, такие как ChatGPT, может быть исправлено в ближайшее время. В апреле 2023 года законодатели ЕС приняли проект Закона об искусственном интеллекте, который требует от компаний, разрабатывающих генеративные технологии искусственного интеллекта, такие как ChatGPT, раскрывать защищенный авторским правом контент, используемый в их разработке.

Предлагаемый закон будет классифицировать инструменты ИИ в зависимости от уровня их риска: от минимального до ограниченного, высокого и неприемлемого.

Основные проблемы включают биометрическое наблюдение, распространение дезинформации и дискриминационные формулировки. Хотя инструменты высокого риска не будут запрещены, их использование потребует высокого уровня прозрачности.

В случае принятия Закон об искусственном интеллекте станет первым в мире всеобъемлющим регулированием искусственного интеллекта. Но до тех пор, пока такие правила не будут приняты, вы обязаны защищать свою конфиденциальность при использовании Chat GPT.

В следующем разделе мы рассмотрим некоторые меры безопасности и рекомендации по использованию ChatGPT.

ChatGPT Меры безопасности и рекомендации

OpenAI реализовал несколько мер безопасности для защиты пользовательских данных и обеспечения безопасности системы ИИ, но пользователям также следует применять определенные передовые методы для минимизации рисков при взаимодействии с ChatGPT.

В этом разделе будут рассмотрены некоторые из лучших практик, которым вы должны следовать.

Ограничьте доступ к конфиденциальной информации . Еще раз избегайте обмена личной или конфиденциальной информацией в разговорах с ChatGPT.

Ознакомьтесь с политиками конфиденциальности . Прежде чем использовать приложение на базе ChatGPT или любую службу, использующую языковые модели OpenAI, внимательно ознакомьтесь с политикой конфиденциальности платформы и методами обработки данных, чтобы получить представление о том, как ваши разговоры хранятся и используются платформой.

Используйте анонимные или псевдонимные учетные записи. По возможности используйте анонимные или псевдонимные учетные записи при взаимодействии с ChatGPT или продуктами, использующими ChatGPT API. Это может помочь свести к минимуму связь данных разговора с вашей реальной личностью.

Мониторинг политик хранения данных: ознакомьтесь с политиками хранения данных используемой вами платформы или службы, чтобы понять, как долго хранятся ваши разговоры, прежде чем они будут анонимизированы или удалены.

Будьте в курсе: будьте в курсе любых изменений в мерах безопасности или политиках конфиденциальности OpenAI и соответствующим образом корректируйте свои методы, чтобы поддерживать высокий уровень безопасности при использовании ChatGPT.

Понимая меры безопасности, реализованные OpenAI, и следуя этим рекомендациям, вы можете свести к минимуму потенциальные риски и обеспечить более безопасный опыт взаимодействия с ChatGPT!

Наши последние мысли о безопасном использовании ChatGPT

Безопасное использование ChatGPT является общей обязанностью разработчиков OpenAI и пользователей, взаимодействующих с системой искусственного интеллекта. OpenAI предпринял значительные шаги для реализации надежных мер безопасности, методов обработки данных и политик конфиденциальности, чтобы обеспечить безопасный опыт для пользователей.

Тем не менее, пользователи также должны проявлять осторожность и применять передовые методы для защиты своей конфиденциальности и личной информации при работе с языковыми моделями.

Ограничивая обмен конфиденциальной информацией, просматривая политики конфиденциальности, используя анонимные учетные записи, отслеживая политики хранения данных и получая информацию о любых изменениях в мерах безопасности, вы можете пользоваться преимуществами ChatGPT, сводя к минимуму потенциальные риски.

Технологии искусственного интеллекта, несомненно, будут все больше интегрироваться в нашу повседневную жизнь, поэтому вы сами должны расставлять приоритеты в отношении своей безопасности и конфиденциальности при взаимодействии с этими мощными инструментами.

Вы пользователь Microsoft Outlook ? Посмотрите наше видео ниже, в нем показано, как легко интегрировать Chat GPT с Outlook!

Как использовать Chat GPT для Power BI: это просто!

ChatGPT для специалистов по обработке и анализу данных: раскрытие информации, основанной на искусственном интеллекте

Как использоватьChat GPT для Excel: руководство для начинающих

Как использовать ChatGPT для написания SQL-запросов

18 способов использовать ChatGPT для бизнеса: увеличьте свою производительность в 5 раз

Как использовать ChatGPT для Python: полное руководство

4 способа использования ChatGPT с PowerApps: пошаговое руководство

Стоит ли использовать ChatGPT Plus? Давай выясним

Кому принадлежит Chat GPT: раскрытие компании, стоящей за ИИ

135+ лучших подсказок ChatGPT: для работы, продуктивности и развлечения