7 correctifs pour le logiciel AMD Adrenalin qui ne fonctionne pas ou ne souvre pas

Vous êtes confronté au problème du logiciel AMD Adrenalin qui ne fonctionne pas ou ne s

La technologie de reconnaissance faciale et ses capacités se sont développées bien au-delà de notre imagination depuis que de nouveaux algorithmes visant à renforcer cette technologie dans les forces de l'ordre ont pris de l'importance. Actuellement, la technologie de reconnaissance faciale est utilisée par les forces de l'ordre aux niveaux les plus bas des processus de collecte de données pour identifier les délinquants au milieu de rassemblements surpeuplés. La technologie utilise des images de caméras de vidéosurveillance dans les lieux publics et les rues, puis compare les données recueillies aux archives de l'agence pour détecter un visage recherché pour des infractions pénales.

Cette technologie a en outre été intégrée dans le plus petit des gadgets, y compris les téléphones mobiles et les appareils portables intelligents. Par conséquent, il ne s'agit pas seulement de vous protéger dans la rue, mais également de protéger vos informations personnelles stockées sur vos appareils intelligents. L'utilisation de « faceprint » pour les pratiques de marketing et de publicité est devenue courante à l'ère moderne des campagnes sur les réseaux sociaux. Et puis, il y a la surveillance privée dans les centres commerciaux, les magasins de détail, etc.

De ce point de vue, on peut rapidement souligner les avantages indéniables de la technologie de reconnaissance faciale. Mais il a également été examiné pour la menace qu'il représente pour la vie privée des utilisateurs, la protection des données et, bien sûr, la transparence entre la loi et le public. C'est une bonne chose d'être conscient des avantages et des inconvénients d'une technologie aussi invasive. Pourtant, il y a un autre inconvénient de la technologie de reconnaissance faciale, que les gens semblent ignorer, et c'est le profilage racial et la discrimination raciale .

Dans cet article, nous examinons comment cette technologie favorise les préjugés et la discrimination raciale et à quel point les répercussions d'une telle technologie invasive sont graves.

Comment fonctionne la reconnaissance faciale ?

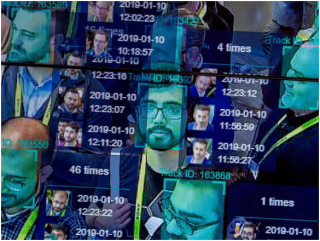

Source de l'image : National Post

Étape 1 : Une photo de vous est prise à partir d'un appareil photo, de votre compte, de votre e-mail, etc. Il s'agit soit d'une photo de profil directe, soit d'un cliché aléatoire dans une foule.

Étape 2 : Le logiciel de reconnaissance faciale exécutera votre visage à travers une base de données d'empreintes faciales stockées. L'empreinte faciale est recueillie via un suivi géométrique de votre visage.

Étape 3 : Un pourcentage de correspondance de votre image par rapport à toute empreinte faciale connue est produit à l'aide d'un algorithme sur lequel une détermination est effectuée.

Biais d'automatisation : l'un des nombreux défauts de la technologie de reconnaissance faciale

Le biais d'automatisation ou le biais machine fait référence au scénario dans lequel un algorithme machine présente un certain biais dans l'étalonnage des données d'entrée, donnant ainsi une sortie défavorable. Cela se produit lorsqu'il y a une erreur dans le code de l'algorithme, un manque d'ensembles de données stockées pour l'étalonnage, des valeurs d'entrée incorrectes ou des données d'entrée excessives, ce qui dépasse la capacité des machines à étalonner.

Comment le profilage racial va-t-il avec tout cela ?

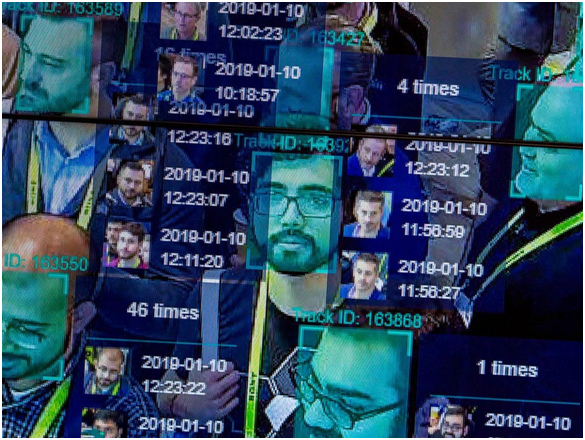

Source de l'image : Le gardien

Commençons par un incident ancien qui à l'époque était jugé insignifiant. En 2001, Tampa City a utilisé un logiciel de reconnaissance faciale pour surveiller la ville surpeuplée alors que les touristes inondaient les rues de la ville en raison du Super Bowl 2001. Selon un rapport du New York Times , le logiciel a identifié 19 personnes qui auraient des mandats d'arrêt non exécutés à leur encontre ; cependant, aucune arrestation n'a été effectuée car l'infrastructure du stade rendait impossible l'accès aux coupables identifiés parmi une foule écrasante.

Bien que les signes de profilage racial n'aient été observés nulle part dans ce cas particulier, c'était la première fois que des techniques de surveillance étaient mises en place contre la violation des libertés civiles et de la vie privée des individus. Dans les années à venir, la police de Tampa a abandonné ces systèmes de surveillance en citant des résultats peu fiables.

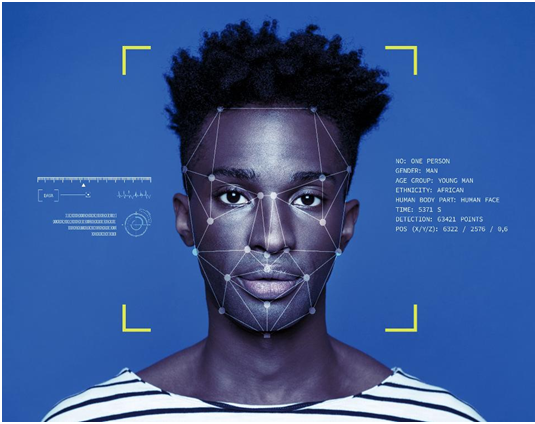

Source de l'image : ICO

Avance rapide vers un scénario un peu plus récent, Ali Breland a rapporté pour The Guardian , concernant l'arrestation de Willie Lynch, un homme noir accusé d'être un trafiquant de drogue notoire dans la région de Brentwood, principalement un quartier de personnes de couleur. La seule preuve contre Lynch était ses photos sur un mobile, qui ont été comparées à une base de données de la police avant que la police ne le détermine comme coupable. Lynch a été condamné pour huit ans, qui a maintenant fait appel de la condamnation. Qu'il soit ou non le revendeur présumé, cela soulève inévitablement des inquiétudes quant à savoir si seul un résultat basé sur une machine est suffisant pour confirmer la condamnation de toute personne faisant l'objet d'une enquête ?

En 2019, comme l'a rapporté Tom Perkins pour The Guardian , la police de Détroit a été trouvée en train d'utiliser la reconnaissance faciale pour procéder à des arrestations au cours des deux dernières années. Detroit est un endroit où plus de 80% de la population est noire. Une déclaration d'un membre noir de la Commission de police de Detroit a soulevé des inquiétudes contre cette pratique. Il a dit que les Noirs ont un trait facial commun qui met en péril l'algorithme du système, qualifiant cela de « techno-racisme ».

Source de l'image : Vox

Dans une recherche de 2019 pour le Journal of Information Communication and Ethics Society, par Fabio Bacchini et Ludovica Lorusso, il a été constaté que ces systèmes biométriques et de reconnaissance faciale ne sont pas fiables à 100 % pour les forces de l'ordre. De plus, la discrimination raciale a un impact négatif sur tous ces systèmes, ce qui a d'autres implications sociétales inverses. L'étude a ciblé les sociétés occidentales en particulier, où de tels systèmes sont largement utilisés pour la surveillance.

Ce ne sont là que trois exemples parmi tant d'autres où des cas de disparités raciales causées par des systèmes de reconnaissance faciale ont été révélés. Mais pourquoi ces systèmes sont-ils si incompétents malgré une précision croissante dans les mises à niveau du codage algorithmique dans la technologie.

Suprématie blanche dans les États occidentaux : une industrie technologique à dominance blanche

En 2014, une majorité d'entreprises technologiques, dont le géant Apple Inc., embauchaient principalement des hommes blancs. Chez Apple, 55% des employés étaient blancs, et de même, la direction d'Apple comprenait 63% d'employés blancs. Les entreprises qui ont partagé des rapports de diversité similaires incluaient également Facebook , Google et Twitter. Cinq ans plus tard, un rapport dans Wired a révélé qu'il y avait eu une amélioration minime de ces chiffres.

Alors que Facebook a montré une amélioration décente en nombre, le pourcentage de travailleurs techniques noirs d'Apple est resté inchangé à seulement 6% de la main-d'œuvre totale. Amazon était la seule organisation à avoir enregistré 42 % de travailleurs noirs ou latino-américains dans ses bureaux américains.

Que signifient ces statistiques ? Aux États-Unis, la plupart des codeurs, qui sont affectés à des projets majeurs tels que la conception d'algorithmes pour les systèmes de surveillance, sont blancs. Ce sont les personnes qui prennent les décisions les plus importantes concernant un produit ou un service à lancer/dévoiler par une entreprise. Et par conséquent, ce sont leurs perspectives, leur approche et leurs processus de pensée qui entrent dans la création finale. Cela ne veut pas dire que les Blancs sont racistes et ont délibérément conçu de tels systèmes de surveillance . NON!

Source de l'image : Forbes

Lorsqu'un homme blanc conçoit un algorithme de reconnaissance faciale et que seuls des collègues blancs le consultent/l'aident, ils ne prennent pas en compte les traits du visage des personnes d'une autre couleur avant de finaliser le code. Étant donné que les ingénieurs blancs dominent l'industrie technologique, les archives de données utilisées pour préparer le code initial sont également créées et calibrées par des techniciens blancs. Ainsi, le code lui-même est créé avec un biais dans son algorithme de calcul de base, ce qui entraîne ces disparités raciales dans les résultats de la surveillance.

Le code apprend simplement ce que les blancs incarnent en lui. Il n'y a aucune perspective ou contribution d'une personne d'une autre couleur.

Les problèmes d'étalonnage

Les forces de l'ordre américaines dépendent fortement de la surveillance et du suivi des données. Il y a eu de nombreux cas où des dénonciateurs ont supprimé des informations concernant la surveillance non autorisée de civils. La révélation par Edward Snowden de la surveillance illégale de la NSA en est un exemple.

Source de l'image : CBS Local

Ces programmes de surveillance s'appuient sur des empreintes faciales et d'autres informations personnelles de millions de citoyens. Si nous ne considérons que les empreintes faciales, il y a des millions d'Américains qui partagent ouvertement des photos sur les plateformes de médias sociaux. Ensuite, il y a des caméras de vidéosurveillance dans chaque rue du pays qui offrent des images en direct de centaines de milliers de passants. Actuellement, il existe environ 117 millions d'images dans les bases de données de la police, tandis que le FBI dispose de plus de 400 millions d'ensembles de données à calibrer dans les algorithmes de reconnaissance faciale de surveillance.

Imaginez maintenant ces ensembles de données comparés à une seule image qui peut ou non avoir capturé tous les traits du visage de la personne en particulier. Dans un tel scénario, des erreurs sont susceptibles de se produire. Il y a tout simplement trop de données à comprendre et à exécuter sur une seule empreinte. Aucun algorithme ne peut garantir à cent pour cent l'assurance de son résultat lorsque l'étalonnage est si compliqué. Cela s'ajoute finalement au profilage racial causé par la technologie de reconnaissance faciale.

L'immense fiabilité de la reconnaissance faciale

Source de l'image: NY Post

Le cas de Willie Lynch rappelle que la reconnaissance faciale ne doit pas être la seule technique fiable présentée comme preuve lorsqu'il s'agit de faire respecter la loi. C'est la raison pour laquelle la police de la ville de Tampa a abandonné la technologie.

Il est vrai que la reconnaissance faciale est un excellent recours et est utile à la police. Les coupables des attentats du marathon de Boston ont été identifiés à l'aide d'une analyse approfondie et détaillée des enregistrements de surveillance. Mais cela ne peut pas être la seule preuve pour condamner qui que ce soit. Il doit y avoir des preuves à l'appui pour prouver les résultats des algorithmes de reconnaissance faciale, et le concept de biais d'automatisation doit être pris en compte avant de prendre une décision finale.

Le problème matériel : la reconnaissance faciale dans les appareils mobiles et les appareils photo

Source de l'image : TechCrunch

Les systèmes de caméras de surveillance et le matériel et les logiciels associés ne sont pas conçus par une seule entreprise. C'est une industrie valant des milliards de dollars dans laquelle des dizaines d'entreprises se font concurrence pour obtenir des contrats des organismes chargés de l'application de la loi. Beaucoup de ces systèmes proviennent de fabricants chinois. Il s'agit d'obtenir la technologie la moins chère avec les meilleures qualités. C'est comme ça que ça marche la plupart du temps. Et par conséquent, il existe toujours des risques de différences dans l'étalonnage des différents systèmes, ainsi que des variations dans la qualité des résultats de la surveillance. De nombreux algorithmes de surveillance par caméra sont inefficaces pour calibrer les images de personnes de couleur simplement à cause de l'incompétence technique, glorifiant ainsi la discrimination raciale.

Les problèmes techniques provoquant le racisme via la reconnaissance faciale ont également été remarqués dans la fonction Apple Face Lock. Une affaire en provenance de Chine a évincé que le verrouillage facial de l'iPhone X était incapable de différencier deux collègues chinois différents, rendant la fonctionnalité inutile. Des rapports similaires ont été rejetés, citant des problèmes dans le reportage en séparant deux personnes noires l'une de l'autre. Comme indiqué ci-dessus, Apple ne compte que 6% de Noirs dans les équipes techniques. C'est un exemple clair de la façon dont une technologie de reconnaissance faciale peut promouvoir le racisme même dans nos appareils portables.

Conclusion

Oui, la reconnaissance faciale est raciste, et c'est de notoriété publique maintenant. Alors que la technologie se développe quotidiennement pour rectifier de tels problèmes, les résultats sont tous les mêmes. La technologie est censée unir le monde autour d'objectifs communs de progrès et de développement techniques, mais certaines techniques ne font que nuire à l'harmonie raciale et communautaire.

Pour l'instant, la meilleure chose que les responsables de l'application des lois puissent faire est de ne pas étayer leurs cas sur la base de preuves provenant d'étalonnages algorithmiques, qui ne sont même pas fiables. De plus, il est grand temps que la diversité et l'inclusion sur les lieux de travail soient prises au sérieux afin que les personnes de toutes les ethnies puissent se réunir pour créer un produit exempt de disparités raciales. Il existe des milliers de races dans le monde et les gens ont grandi pour mettre de côté les différences raciales, qui ont hanté la société mondiale pendant si longtemps. Si cela doit être maintenu, alors les machines sur lesquelles nous nous appuyons tant doivent être enseignées de la même manière.

Vous êtes confronté au problème du logiciel AMD Adrenalin qui ne fonctionne pas ou ne s

Pour corriger l

Apprenez à maîtriser le chat Zoom, une fonctionnalité essentielle pour les visioconférences, avec nos conseils et astuces.

Découvrez notre examen approfondi de l

Découvrez comment récupérer votre Instagram après avoir été désactivé en suivant nos étapes claires et simples.

Découvrez comment savoir qui a consulté votre profil Instagram avec nos solutions pratiques. Sauvegardez votre vie privée tout en restant informé !

Apprenez à créer des GIF animés facilement avec votre Galaxy S22. Découvrez les méthodes intégrées et des applications pratiques pour enrichir votre expérience.

Découvrez comment changer la devise dans Google Maps en quelques étapes simples pour mieux planifier vos finances durant votre voyage.

Microsoft Teams s

Vous obtenez l